100일간의 머신러닝 코드

Siraj Raval이 제안한 100일간의 머신러닝 코딩

여기에서 데이터셋을 받으세요.

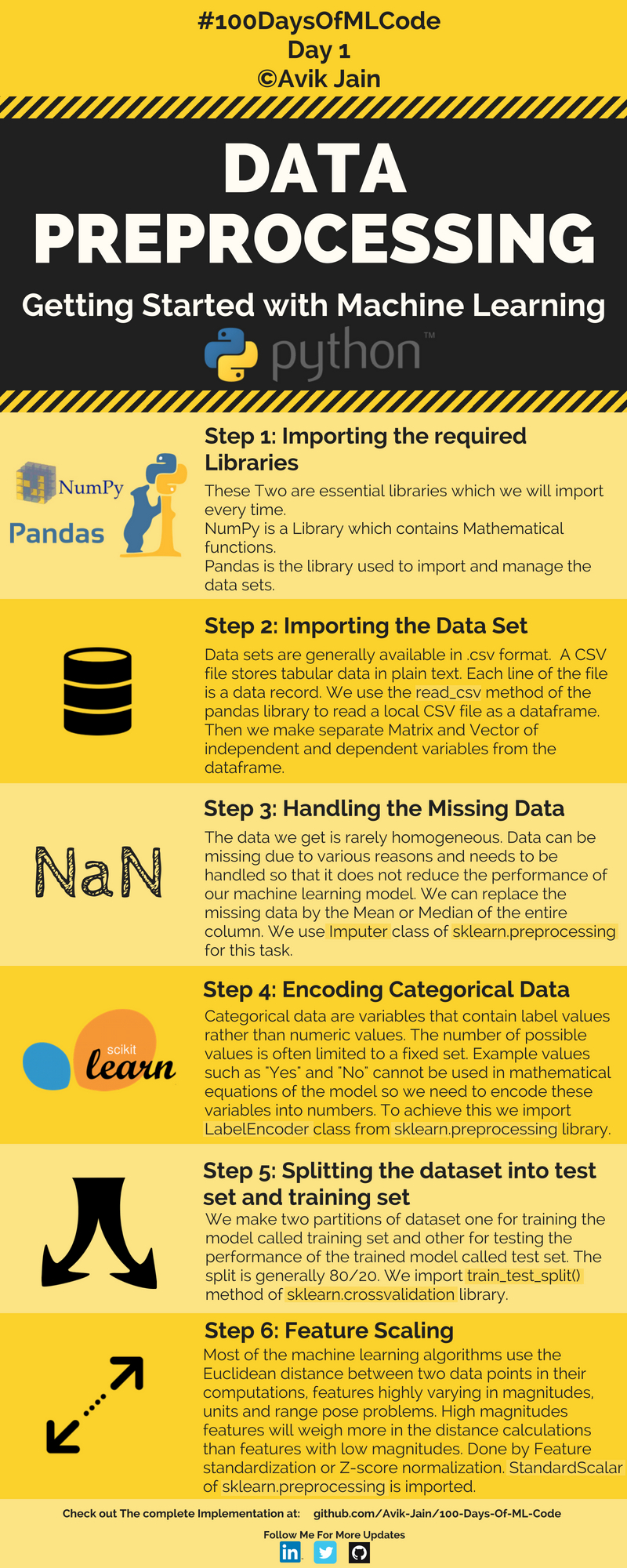

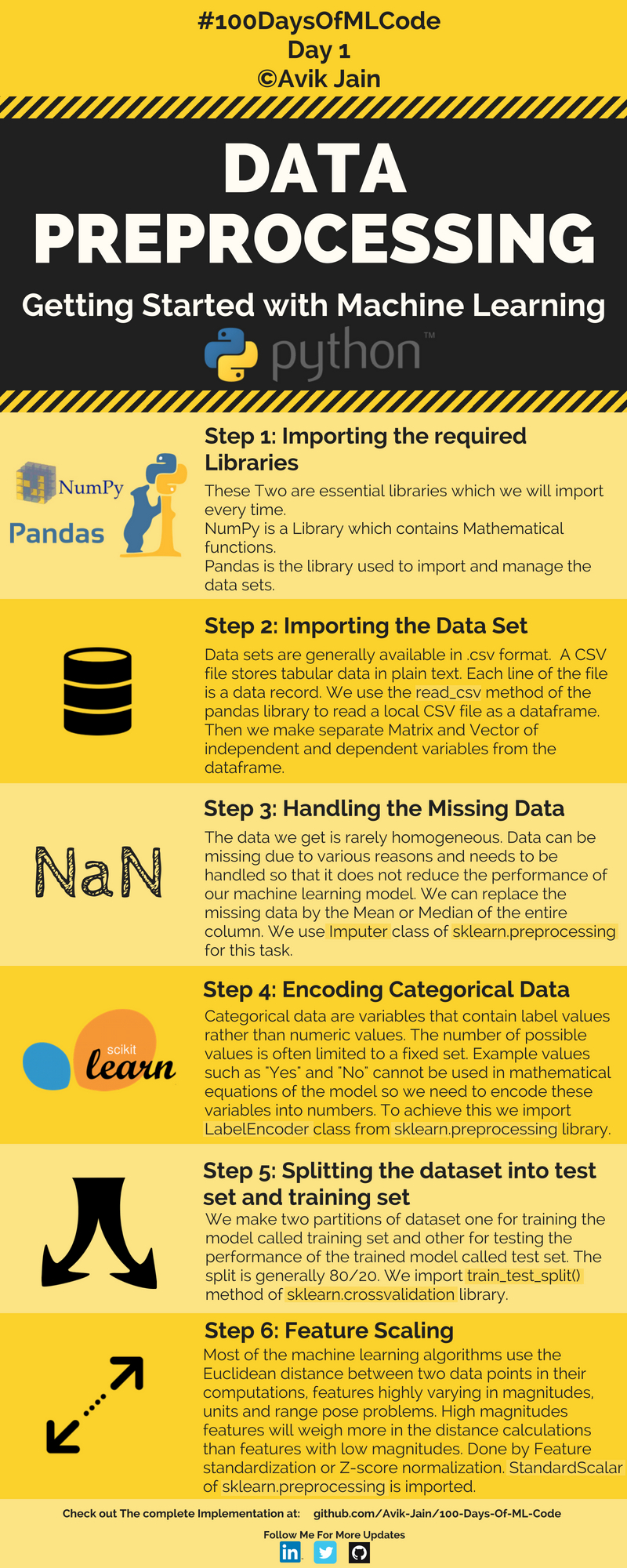

데이터 전처리 | 1일차

여기에서 코드를 확인하세요.

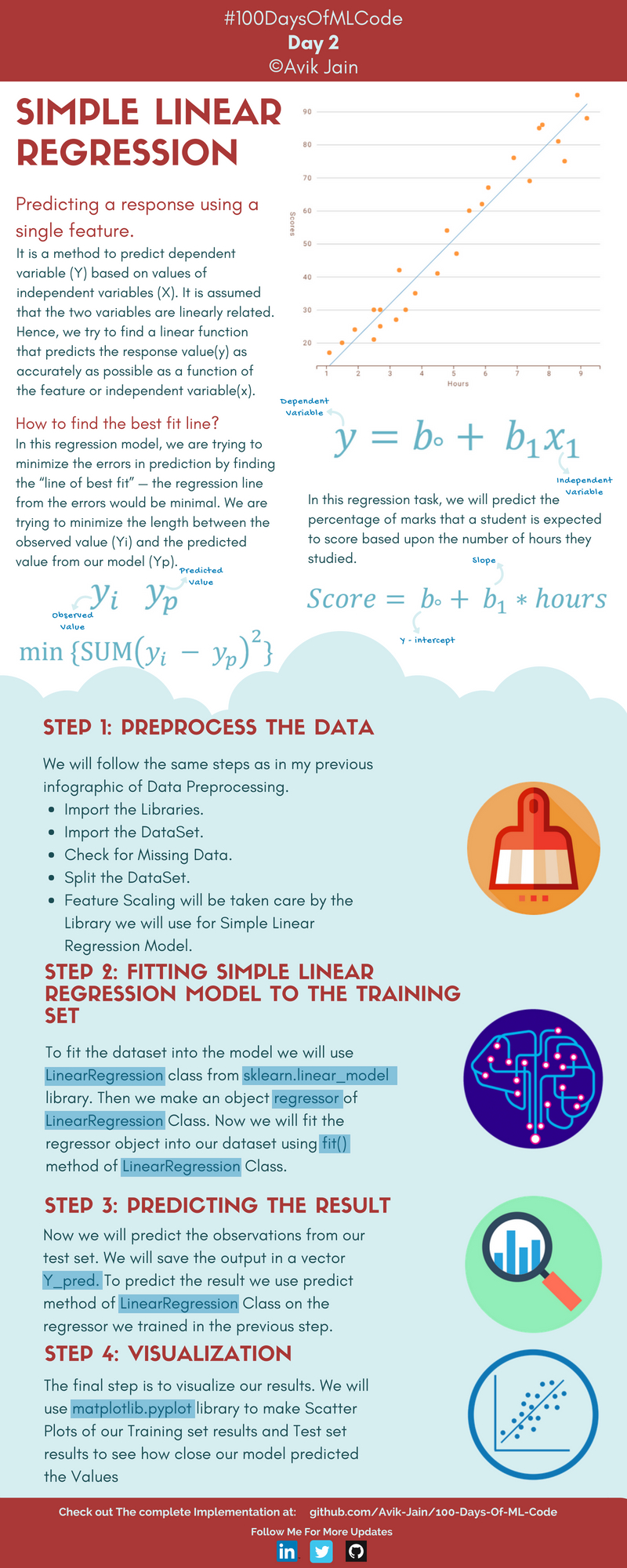

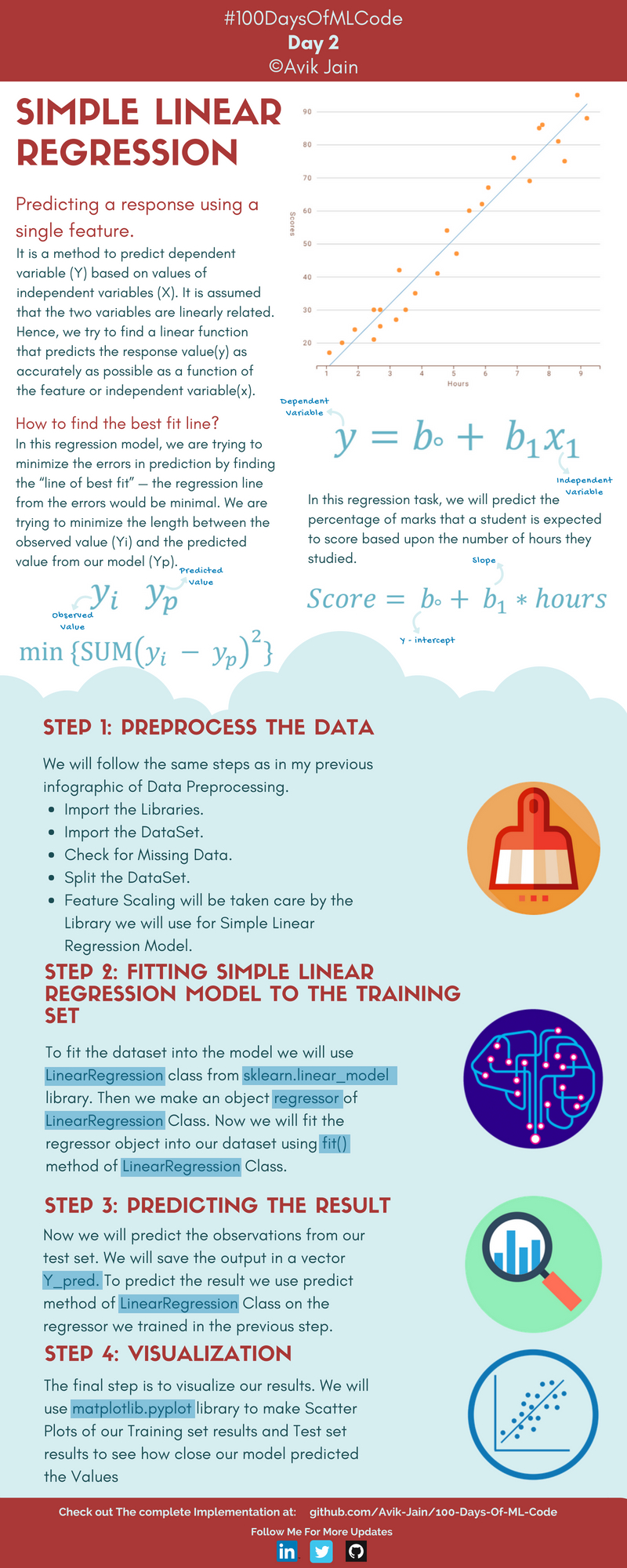

단순 선형 회귀 | 2일차

여기에서 코드를 확인하세요.

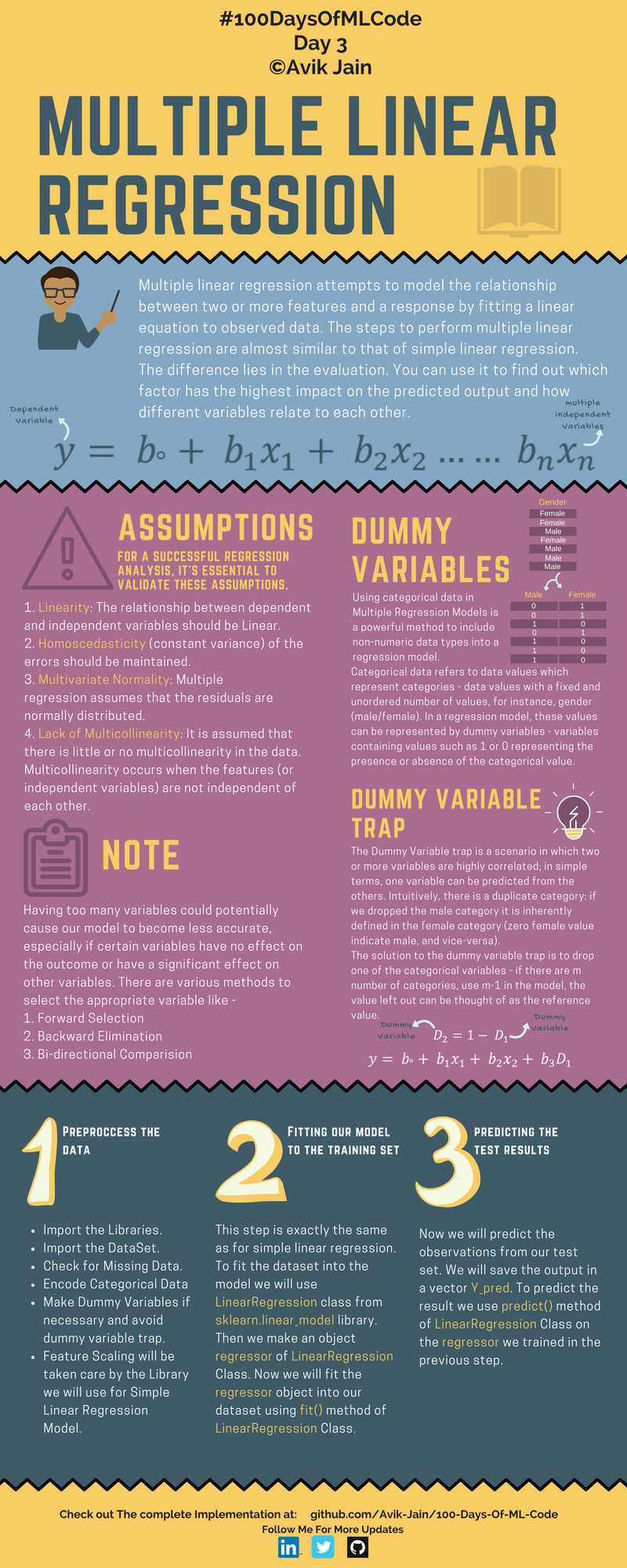

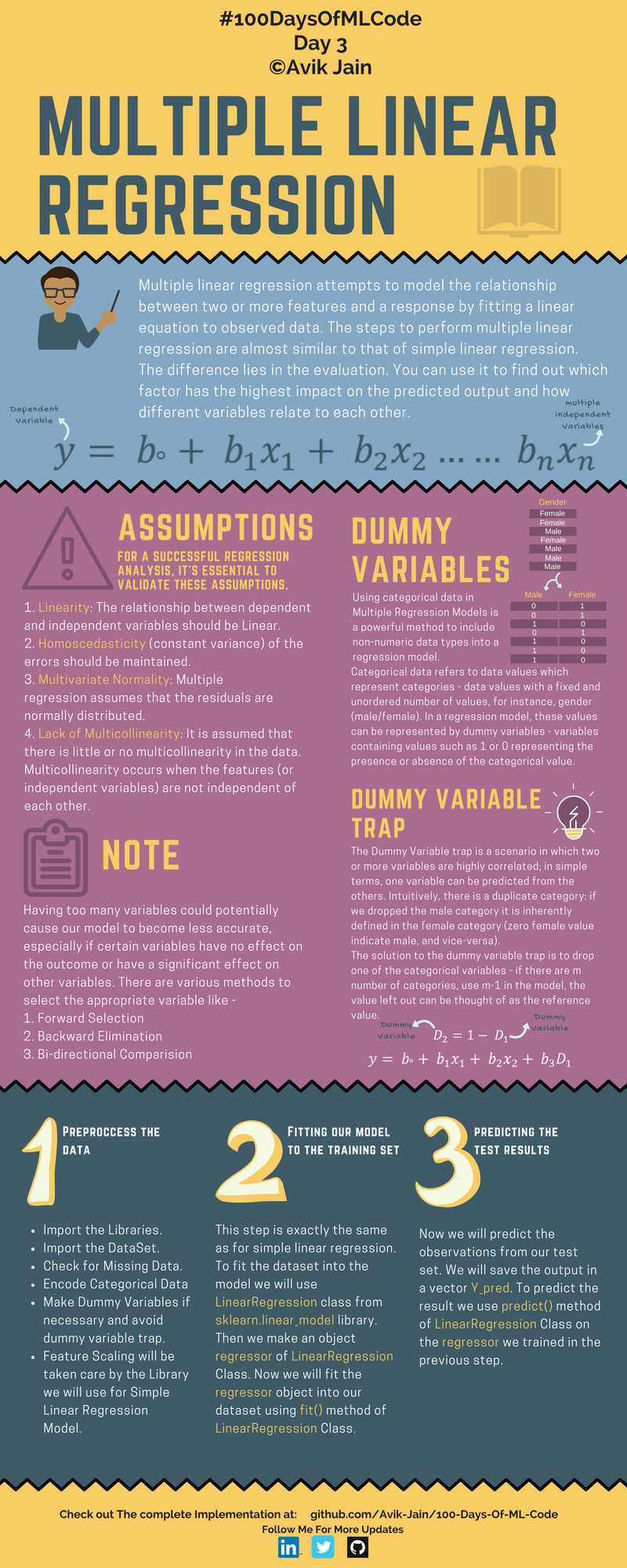

다중 선형 회귀 | 3일차

여기에서 코드를 확인하세요.

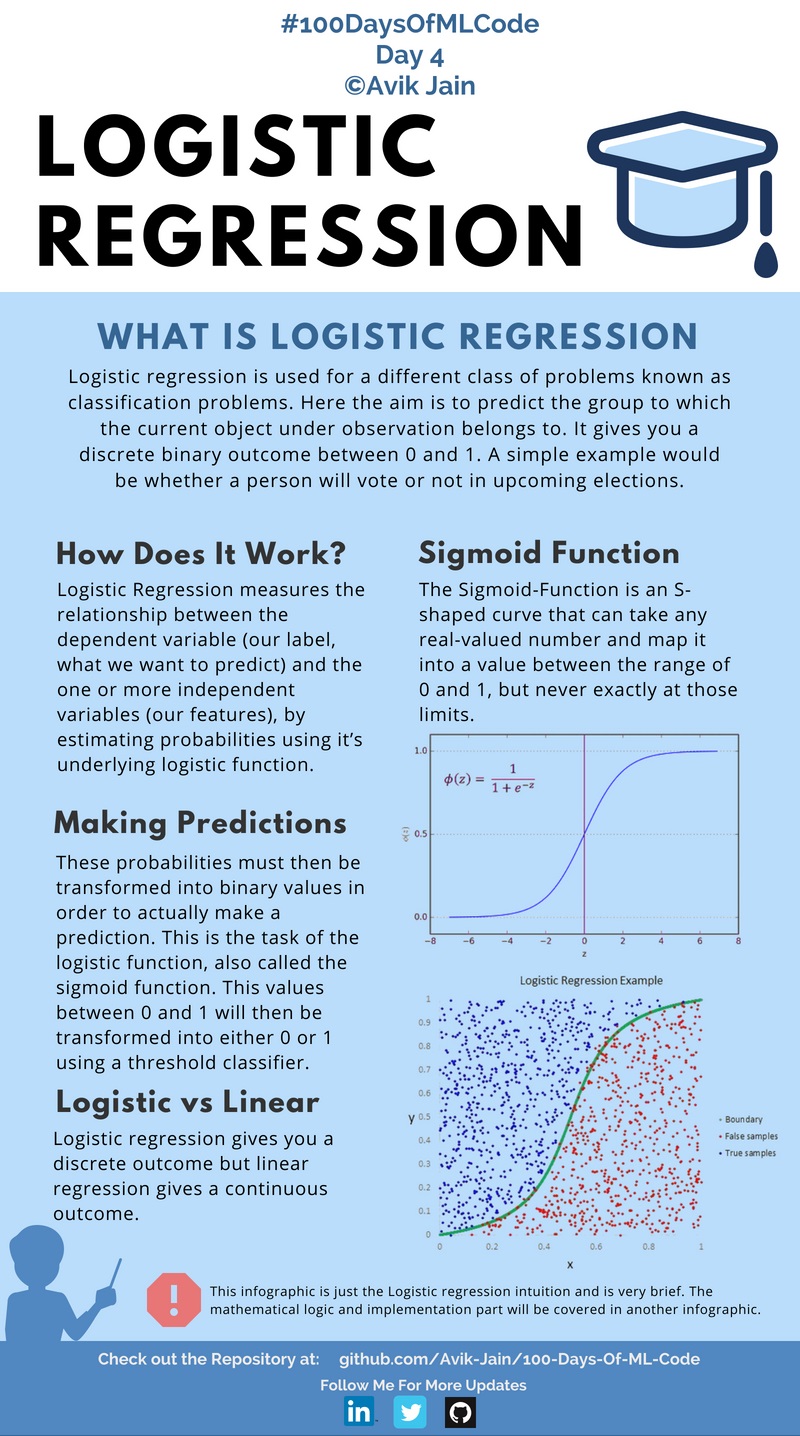

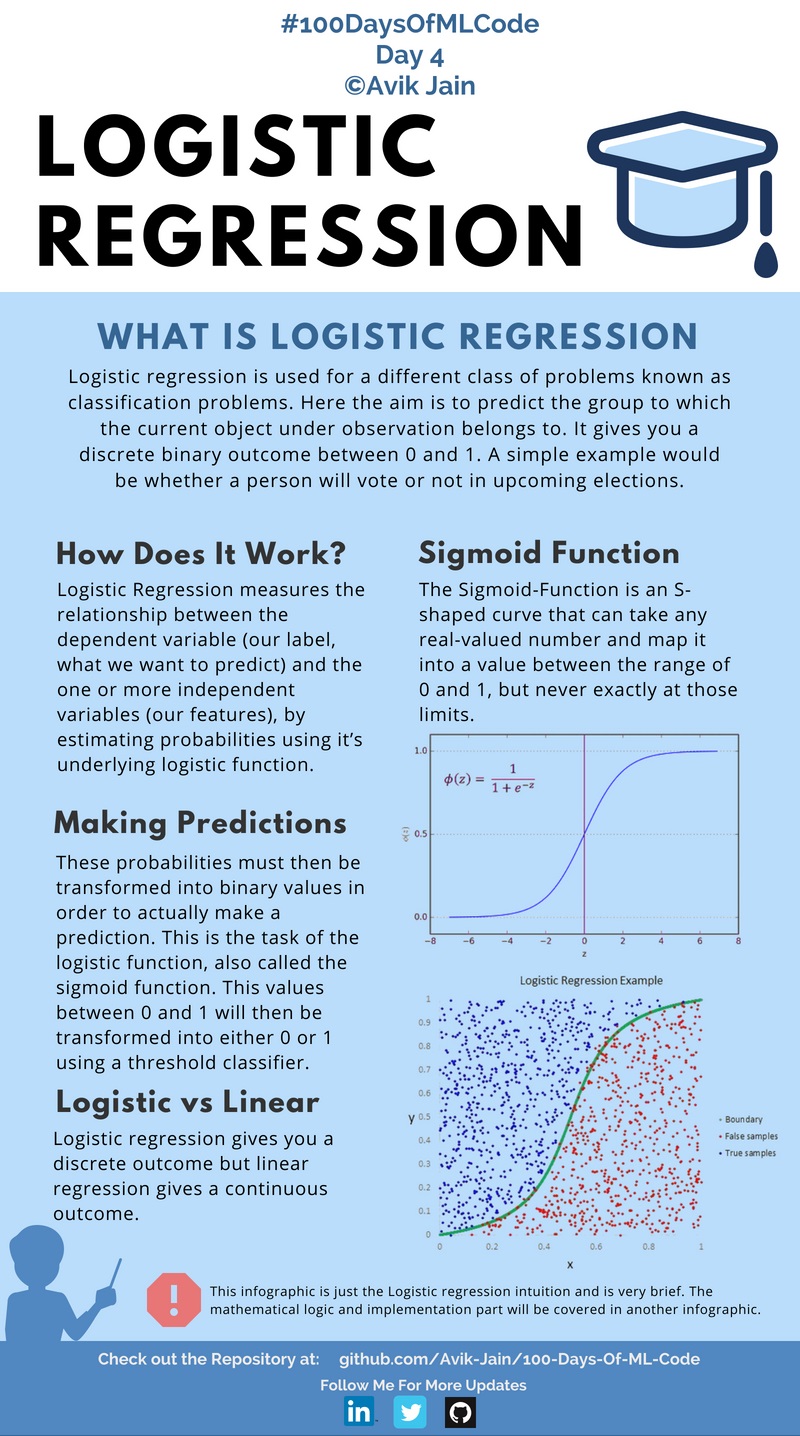

로지스틱 회귀 | 4일차

로지스틱 회귀 | 5일차

#100DaysOfMLCode를 진행하면서 오늘 로지스틱 회귀가 실제로 무엇이며 그 뒤에 숨겨진 수학은 무엇인지 더 깊이 파고들었습니다. 비용 함수가 어떻게 계산되는지, 그리고 예측 오류를 최소화하기 위해 비용 함수에 경사 하강 알고리즘을 적용하는 방법을 배웠습니다. 시간이 부족하여 이제 격일로 인포그래픽을 게시할 예정입니다. 또한 코드 문서화에 도움을 주실 분이 있고 이미 해당 분야에 경험이 있으며 github용 Markdown을 알고 계신다면 LinkedIn으로 저에게 연락해 주세요 :).

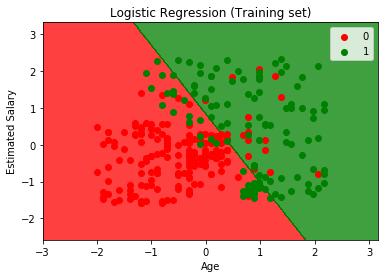

로지스틱 회귀 구현 | 6일차

여기에서 코드를 확인하세요.

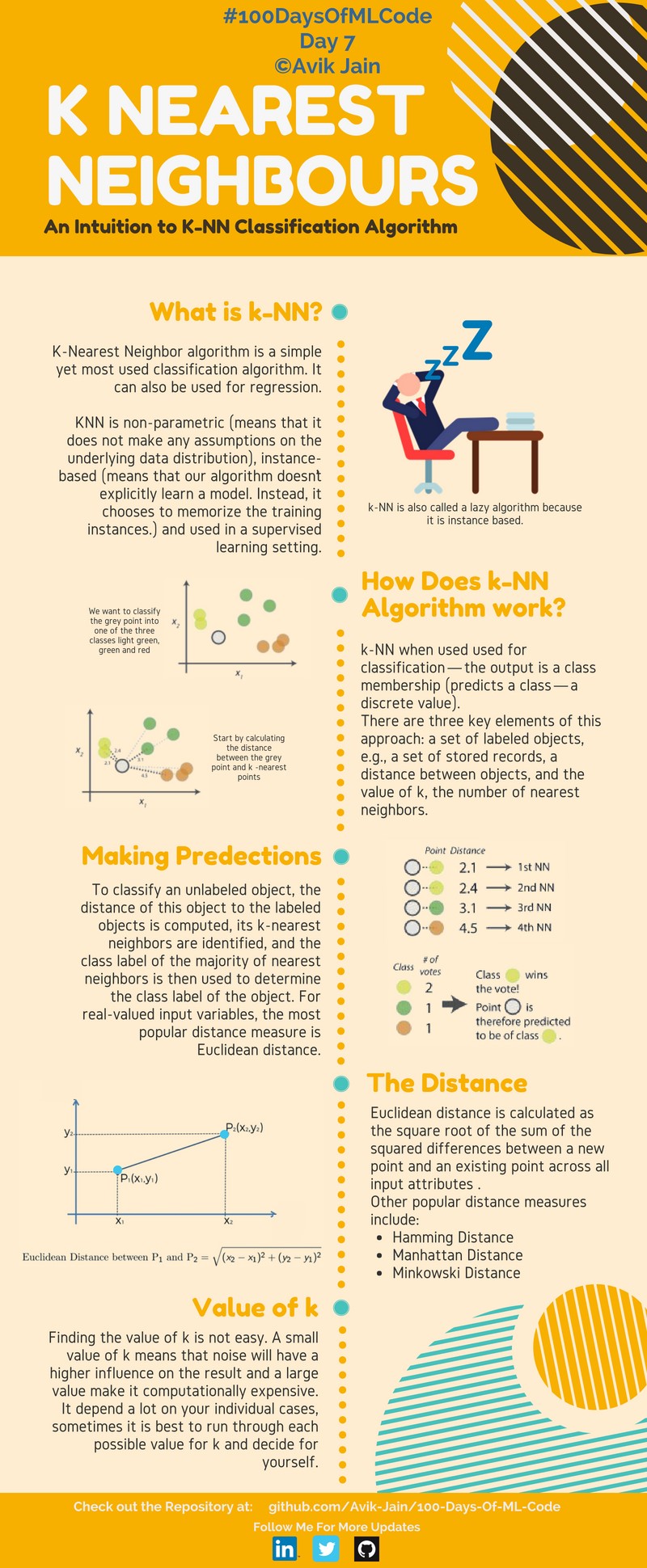

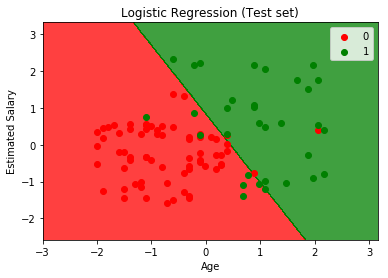

K 최근접 이웃 | 7일차

로지스틱 회귀의 수학적 원리 | 8일차

#100DaysOfMLCode 로지스틱 회귀에 대한 이해를 명확히 하기 위해 인터넷에서 자료나 기사를 검색하다가 Saishruthi Swaminathan의 이 기사(https://towardsdatascience.com/logistic-regression-detailed-overview-46c4da4303bc)를 발견했습니다.

로지스틱 회귀에 대한 자세한 설명을 제공합니다. 확인해 보세요.

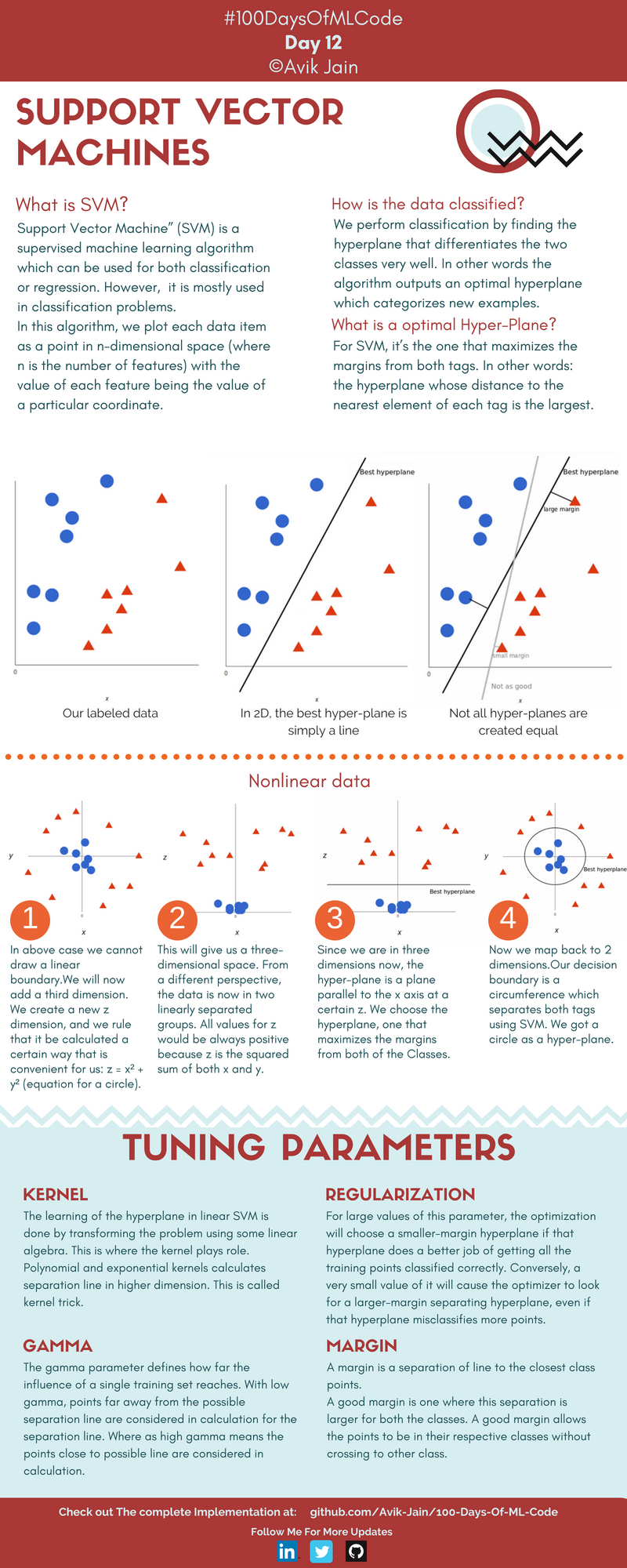

서포트 벡터 머신 | 9일차

SVM이 무엇이며 분류 문제를 해결하는 데 어떻게 사용되는지에 대한 직관을 얻었습니다.

SVM 및 KNN | 10일차

SVM 작동 방식에 대해 더 자세히 배우고 K-NN 알고리즘을 구현했습니다.

K-NN 구현 | 11일차

분류를 위한 K-NN 알고리즘을 구현했습니다. #100DaysOfMLCode 서포트 벡터 머신 인포그래픽이 절반 정도 완료되었습니다. 내일 업데이트하겠습니다.

서포트 벡터 머신 | 12일차

나이브 베이즈 분류기 | 13일차

#100DaysOfMLCode를 계속 진행하면서 오늘 나이브 베이즈 분류기를 살펴보았습니다. 또한 scikit-learn을 사용하여 파이썬으로 SVM을 구현하고 있습니다. 코드는 곧 업데이트하겠습니다.

SVM 구현 | 14일차

오늘 선형적으로 관련된 데이터에 SVM을 구현했습니다. Scikit-Learn 라이브러리를 사용했습니다. Scikit-Learn에는 이 작업을 수행하는 데 사용하는 SVC 분류기가 있습니다. 다음 구현에서는 커널 트릭을 사용할 예정입니다. 여기에서 코드를 확인하세요.

나이브 베이즈 분류기 및 블랙박스 머신러닝 | 15일차

다양한 유형의 나이브 베이즈 분류기에 대해 배웠습니다. 또한 Bloomberg의 강의를 듣기 시작했습니다. 재생 목록의 첫 번째 강의는 블랙박스 머신러닝이었습니다. 예측 함수, 특징 추출, 학습 알고리즘, 성능 평가, 교차 검증, 샘플 편향, 비정상성, 과적합 및 하이퍼파라미터 튜닝에 대한 전체 개요를 제공합니다.

커널 트릭을 사용한 SVM 구현 | 16일차

Scikit-Learn 라이브러리를 사용하여 데이터 포인트를 더 높은 차원으로 매핑하여 최적의 초평면을 찾는 커널 함수와 함께 SVM 알고리즘을 구현했습니다.

Coursera에서 딥러닝 전문 과정 시작 | 17일차

하루 만에 1주차와 2주차 전체를 완료했습니다. 신경망으로서의 로지스틱 회귀를 배웠습니다.

Coursera에서 딥러닝 전문 과정 | 18일차

딥러닝 전문 과정의 첫 번째 과정을 완료했습니다. 파이썬으로 신경망을 구현했습니다.

학습 문제, Yaser Abu-Mostafa 교수 | 19일차

Yaser Abu-Mostafa 교수의 Caltech 머신러닝 과정(CS 156) 18개 강의 중 첫 번째 강의를 시작했습니다. 기본적으로 다음 강의에 대한 소개였습니다. 또한 퍼셉트론 알고리즘에 대해서도 설명했습니다.

딥러닝 전문 과정 2 시작 | 20일차

심층 신경망 개선: 하이퍼파라미터 튜닝, 정규화 및 최적화 1주차를 완료했습니다.

웹 스크래핑 | 21일차

모델 구축을 위한 데이터 수집을 위해 Beautiful Soup을 사용하여 웹 스크래핑을 수행하는 방법에 대한 몇 가지 튜토리얼을 시청했습니다.

학습은 가능한가? | 22일차

Yaser Abu-Mostafa 교수의 Caltech 머신러닝 과정(CS 156) 18개 강의 중 두 번째 강의. 호프딩 부등식에 대해 배웠습니다.

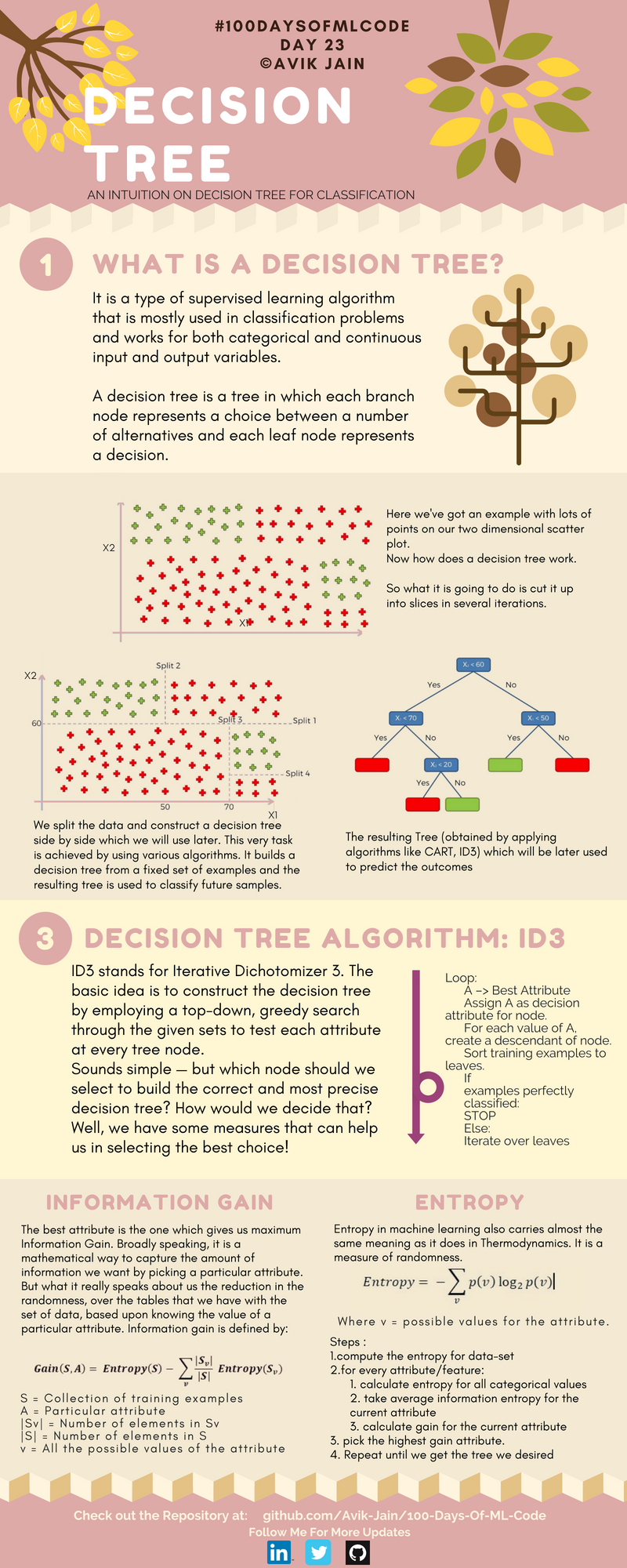

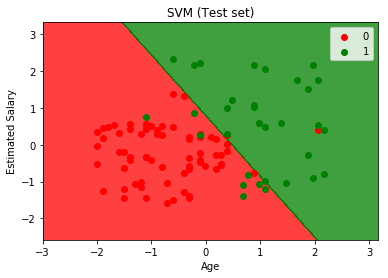

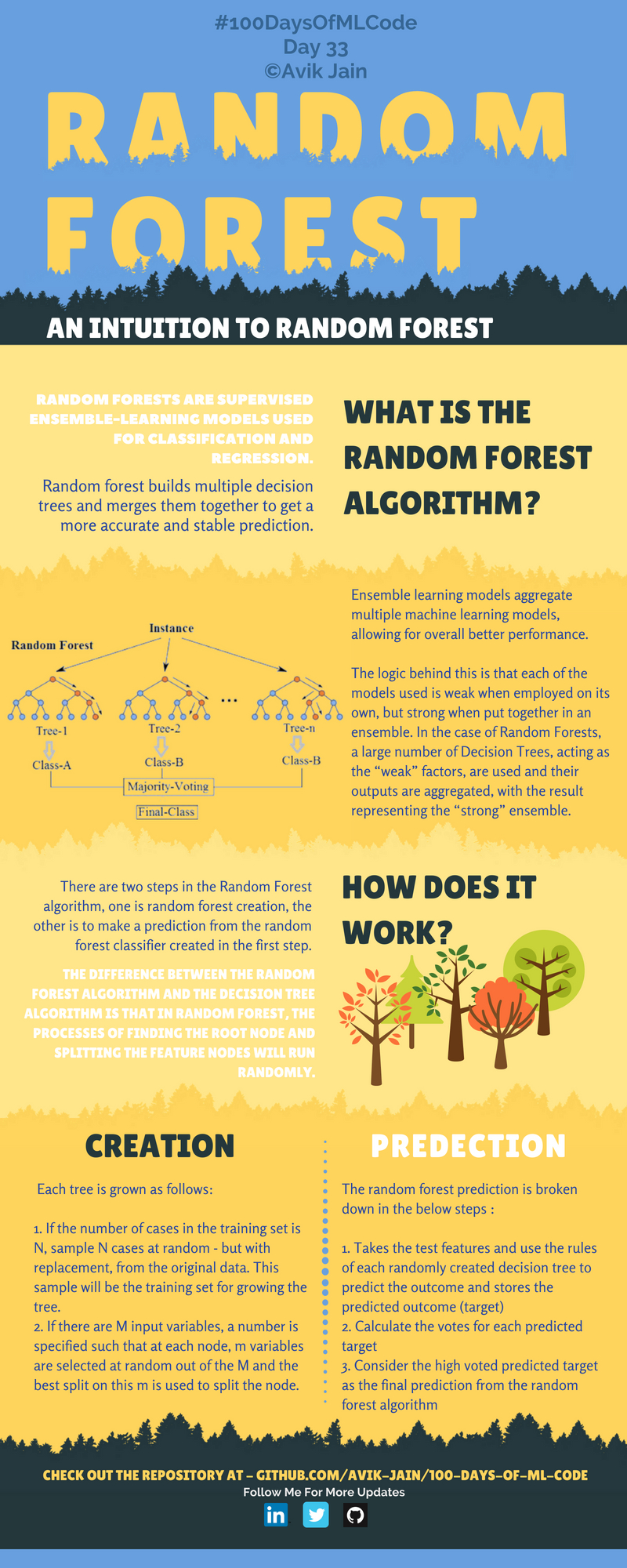

결정 트리 | 23일차

통계 학습 이론 소개 | 24일차

Bloomberg ML 과정의 세 번째 강의에서는 입력 공간, 행동 공간, 결과 공간, 예측 함수, 손실 함수 및 가설 공간과 같은 핵심 개념 중 일부를 소개했습니다.

결정 트리 구현 | 25일차

여기에서 코드를 확인하세요.

선형 대수 복습으로 이동 | 26일차

유튜브에서 3Blue1Brown이라는 놀라운 채널을 발견했습니다. 선형 대수의 본질이라는 재생 목록이 있습니다. 벡터, 선형 조합, 스팬, 기저 벡터, 선형 변환 및 행렬 곱셈에 대한 전체 개요를 제공하는 4개의 비디오를 완료하며 시작했습니다.

재생 목록 링크는 여기입니다.

선형 대수 복습으로 이동 | 27일차

재생 목록을 계속 진행하면서 3D 변환, 행렬식, 역행렬, 열 공간, 영 공간 및 비정방 행렬 주제를 다루는 다음 4개의 비디오를 완료했습니다.

재생 목록 링크는 여기입니다.

선형 대수 복습으로 이동 | 28일차

3Blue1Brown의 재생 목록에서 선형 대수의 본질에서 3개의 비디오를 추가로 완료했습니다. 다룬 주제는 내적과 외적이었습니다.

재생 목록 링크는 여기입니다.

선형 대수 복습으로 이동 | 29일차

오늘 12-14번 비디오를 통해 전체 재생 목록을 완료했습니다. 선형 대수 개념을 복습하기에 정말 놀라운 재생 목록입니다. 다룬 주제는 기저 변경, 고유 벡터 및 고유값, 추상 벡터 공간이었습니다.

재생 목록 링크는 여기입니다.

미적분학의 본질 | 30일차

3blue1brown의 선형 대수의 본질 재생 목록을 완료하자 유튜브에서 같은 채널 3Blue1Brown의 비디오 시리즈에 대한 제안이 나타났습니다. 이미 이전 선형 대수 시리즈에 깊은 인상을 받았기 때문에 바로 뛰어들었습니다. 도함수, 연쇄 법칙, 곱셈 법칙 및 지수 함수의 도함수와 같은 주제에 대한 약 5개의 비디오를 완료했습니다.

재생 목록 링크는 여기입니다.

미적분학의 본질 | 31일차

미적분학의 본질 재생 목록에서 음함수 미분 및 극한 주제에 대한 2개의 비디오를 시청했습니다.

재생 목록 링크는 여기입니다.

미적분학의 본질 | 32일차

적분 및 고계 도함수와 같은 주제를 다루는 나머지 4개의 비디오를 시청했습니다.

재생 목록 링크는 여기입니다.

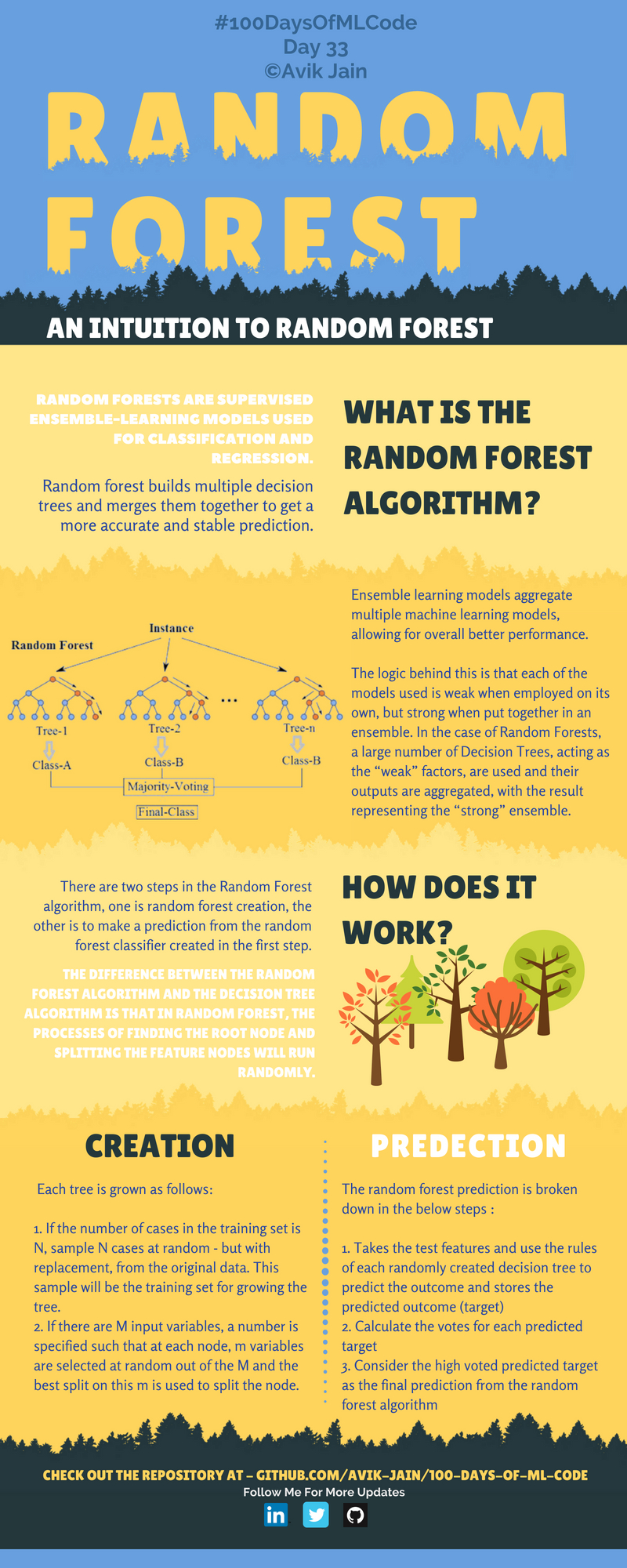

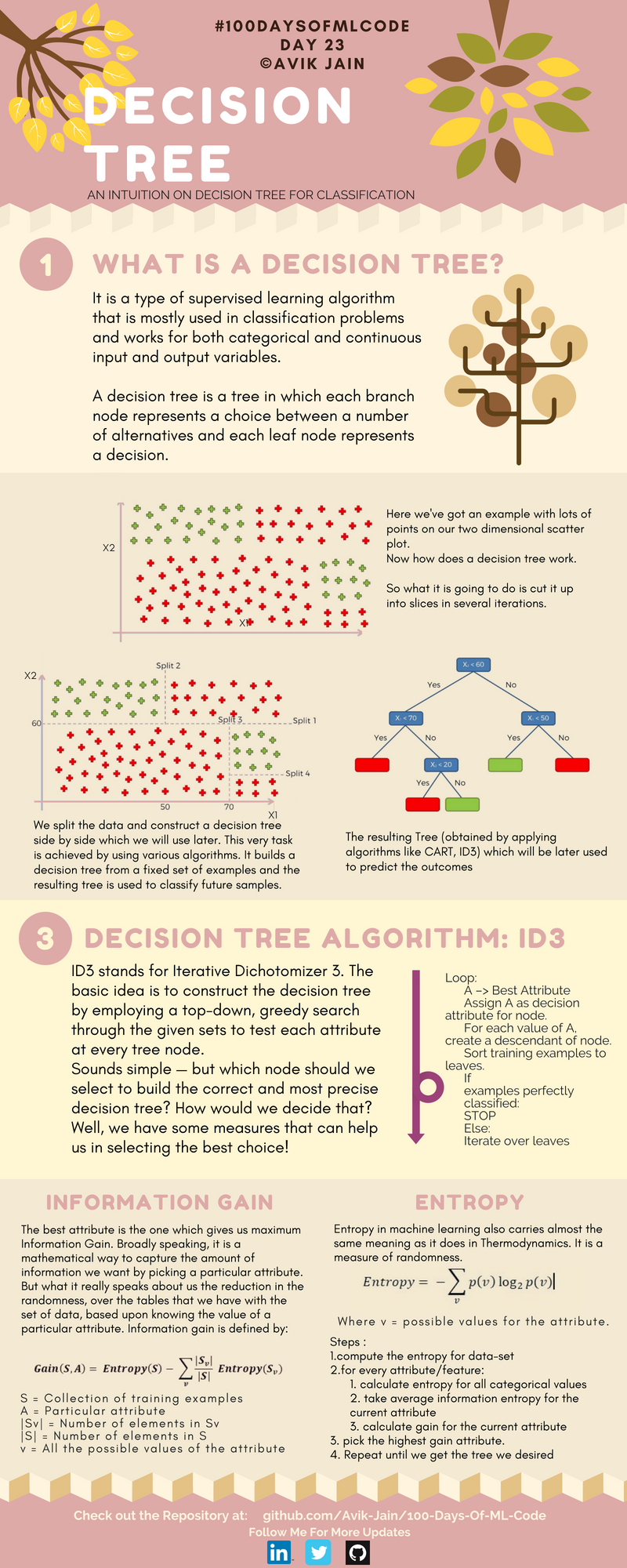

랜덤 포레스트 | 33일차

랜덤 포레스트 구현 | 34일차

여기에서 코드를 확인하세요.

하지만 신경망이란 무엇일까요? | 딥러닝, 1장 | 35일차

3Blue1Brown 유튜브 채널의 신경망에 대한 놀라운 비디오. 이 비디오는 신경망에 대한 이해를 돕고 손으로 쓴 숫자 데이터셋을 사용하여 개념을 설명합니다. 비디오 링크입니다.

경사 하강, 신경망이 학습하는 방법 | 딥러닝, 2장 | 36일차

3Blue1Brown 유튜브 채널의 신경망 2부. 이 비디오는 흥미로운 방식으로 경사 하강 개념을 설명합니다. 169 꼭 봐야 할 강력 추천 비디오입니다. 비디오 링크입니다.

역전파는 실제로 무엇을 하고 있을까요? | 딥러닝, 3장 | 37일차

3Blue1Brown 유튜브 채널의 신경망 3부. 이 비디오는 주로 편도함수와 역전파에 대해 설명합니다. 비디오 링크입니다.

역전파 미적분학 | 딥러닝, 4장 | 38일차

3Blue1Brown 유튜브 채널의 신경망 4부. 여기서 목표는 역전파가 작동하는 방식에 대한 직관을 다소 공식적인 용어로 표현하는 것이며 비디오는 주로 편도함수와 역전파에 대해 설명합니다. 비디오 링크입니다.

파이썬, 텐서플로우, 케라스를 사용한 딥러닝 튜토리얼 | 39일차

비디오 링크입니다.

자체 데이터 로드 - 파이썬, 텐서플로우, 케라스를 사용한 딥러닝 기초 2부 | 40일차

비디오 링크입니다.

컨볼루션 신경망 - 파이썬, 텐서플로우, 케라스를 사용한 딥러닝 기초 3부 | 41일차

비디오 링크입니다.

텐서보드를 사용한 모델 분석 - 파이썬, 텐서플로우, 케라스를 사용한 딥러닝 4부 | 42일차

비디오 링크입니다.

K 평균 군집화 | 43일차

비지도 학습으로 넘어가 군집화에 대해 공부했습니다. 제 웹사이트 avikjain.me를 확인해 보세요. 또한 K 평균 군집화를 쉽게 이해하는 데 도움이 되는 멋진 애니메이션을 찾았습니다. 링크

K 평균 군집화 구현 | 44일차

K 평균 군집화를 구현했습니다. 여기에서 코드를 확인하세요.

더 깊이 파고들기 | NUMPY | 45일차

JK VanderPlas의 새 책 “Python Data Science HandBook“을 받았습니다. 여기에서 Jupyter 노트북을 확인하세요.

2장 Numpy 소개부터 시작했습니다. 데이터 유형, Numpy 배열 및 Numpy 배열 연산과 같은 주제를 다루었습니다.

코드를 확인하세요 -

NumPy 소개

파이썬의 데이터 유형 이해

NumPy 배열의 기초

NumPy 배열 연산: 유니버설 함수

더 깊이 파고들기 | NUMPY | 46일차

2장: 집계, 비교 및 브로드캐스팅

노트북 링크:

집계: 최소, 최대 및 그 사이의 모든 것

배열 연산: 브로드캐스팅

비교, 마스크 및 부울 논리

더 깊이 파고들기 | NUMPY | 47일차

2장: 팬시 인덱싱, 배열 정렬, 구조화된 데이터

노트북 링크:

팬시 인덱싱

배열 정렬

구조화된 데이터: NumPy의 구조화된 배열

더 깊이 파고들기 | PANDAS | 48일차

3장: Pandas를 사용한 데이터 조작

Pandas 객체, 데이터 인덱싱 및 선택, 데이터 연산, 누락된 데이터 처리, 계층적 인덱싱, ConCat 및 Append와 같은 다양한 주제를 다루었습니다.

노트북 링크:

Pandas를 사용한 데이터 조작

Pandas 객체 소개

데이터 인덱싱 및 선택

Pandas의 데이터 연산

누락된 데이터 처리

계층적 인덱싱

데이터셋 결합: Concat 및 Append

더 깊이 파고들기 | PANDAS | 49일차

3장: 다음 주제 완료 - 병합 및 조인, 집계 및 그룹화, 피벗 테이블.

데이터셋 결합: 병합 및 조인

집계 및 그룹화

피벗 테이블

더 깊이 파고들기 | PANDAS | 50일차

3장: 벡터화된 문자열 연산, 시계열 작업

노트북 링크:

벡터화된 문자열 연산

시계열 작업

고성능 Pandas: eval() 및 query()

더 깊이 파고들기 | MATPLOTLIB | 51일차

4장: Matplotlib을 사용한 시각화

단순 선 플롯, 단순 산점도, 밀도 및 등고선 플롯에 대해 배웠습니다.

노트북 링크:

Matplotlib을 사용한 시각화

단순 선 플롯

단순 산점도

오류 시각화

밀도 및 등고선 플롯

더 깊이 파고들기 | MATPLOTLIB | 52일차

4장: Matplotlib을 사용한 시각화

히스토그램, 플롯 범례 사용자 지정 방법, 색상 막대 및 다중 서브플롯 만들기에 대해 배웠습니다.

노트북 링크:

히스토그램, 구간화 및 밀도

플롯 범례 사용자 지정

색상 막대 사용자 지정

다중 서브플롯

텍스트 및 주석

더 깊이 파고들기 | MATPLOTLIB | 53일차

4장: Mathplotlib의 3차원 플로팅을 다루었습니다.

노트북 링크:

Matplotlib의 3차원 플로팅

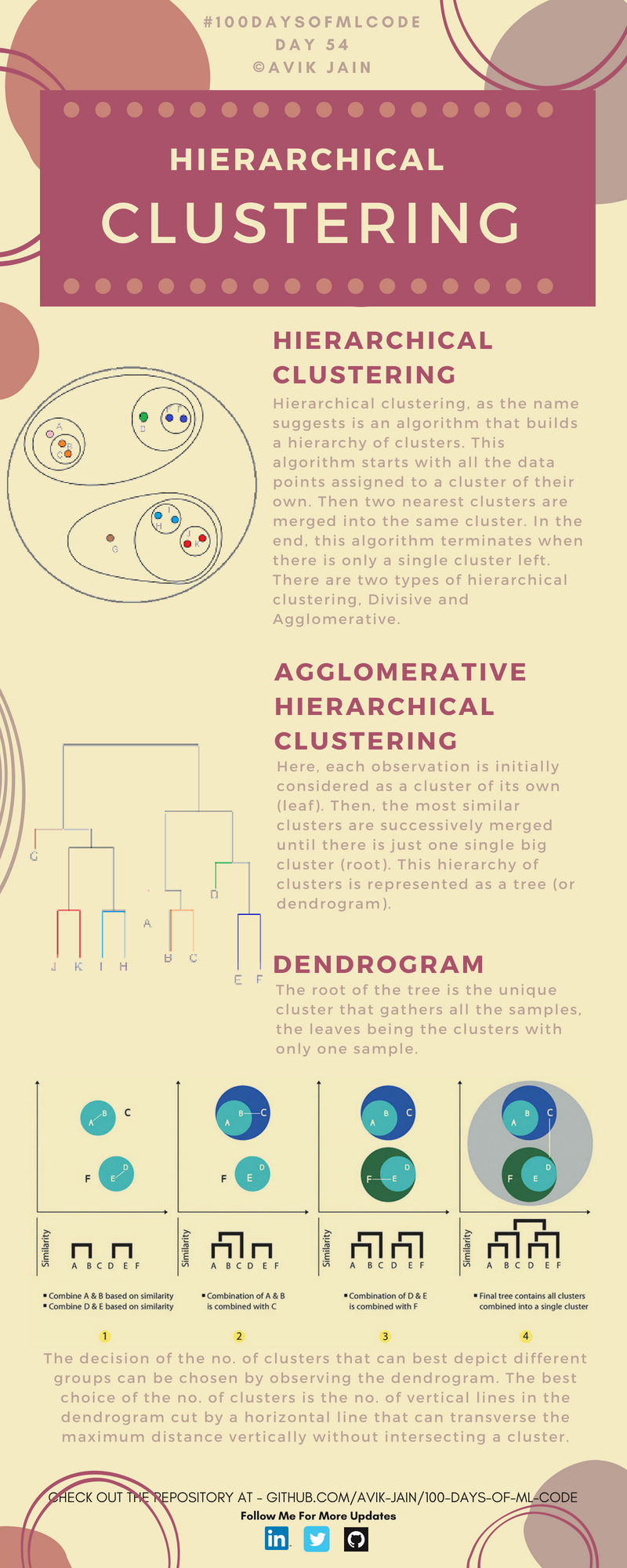

계층적 군집화 | 54일차

계층적 군집화에 대해 공부했습니다. 이 놀라운 시각화를 확인해 보세요.

강화 학습 소개 | 55일차

강화 학습(RL)의 기본 개념과 용어(에이전트, 환경, 보상, 정책, 가치 함수)를 학습했습니다. 자세히 보기

마르코프 결정 과정 | 56일차

강화 학습의 핵심 프레임워크인 마르코프 결정 과정(MDP)에 대해 학습했습니다. 자세히 보기

Q-러닝 - 이론 및 알고리즘 | 57일차

모델 프리 강화 학습 알고리즘인 Q-러닝의 이론적 배경과 작동 방식에 대해 학습했습니다. 자세히 보기

Q-러닝 - 간단한 구현 | 58일차

간단한 예제(예: 그리드 월드)를 통해 Q-러닝을 구현하는 방법을 학습했습니다. 코드

심층 Q-네트워크 (DQN) | 59일차

Q-러닝과 심층 신경망을 결합한 심층 Q-네트워크(DQN)의 개념과 장점에 대해 학습했습니다. 자세히 보기

자연어 처리 소개 | 60일차

자연어 처리(NLP)의 기본 개념과 용어(코퍼스, 토큰, 임베딩)를 학습했습니다. 자세히 보기

텍스트 전처리 | 61일차

NLP의 중요한 단계인 텍스트 전처리 기법(토큰화, 어간 추출, 표제어 추출)에 대해 학습했습니다. 자세히 보기

Bag-of-Words 및 TF-IDF | 62일차

텍스트 데이터를 수치 벡터로 변환하는 대표적인 방법인 Bag-of-Words와 TF-IDF에 대해 학습하고 구현했습니다. 코드

단어 임베딩 - Word2Vec, GloVe (개념) | 63일차

단어의 의미를 밀집 벡터로 표현하는 단어 임베딩 기법인 Word2Vec과 GloVe의 개념에 대해 학습했습니다. 자세히 보기

Word2Vec 구현 | 64일차

Gensim 라이브러리를 사용하여 Word2Vec을 구현하는 방법을 학습했습니다. 코드

감성 분석 - 기본 기법 | 65일차

텍스트에 나타난 감성을 분석하는 기본 기법들에 대해 학습했습니다. 자세히 보기

간단한 감성 분석기 구축 | 66일차

학습한 내용을 바탕으로 간단한 감성 분석기를 구축했습니다. 코드

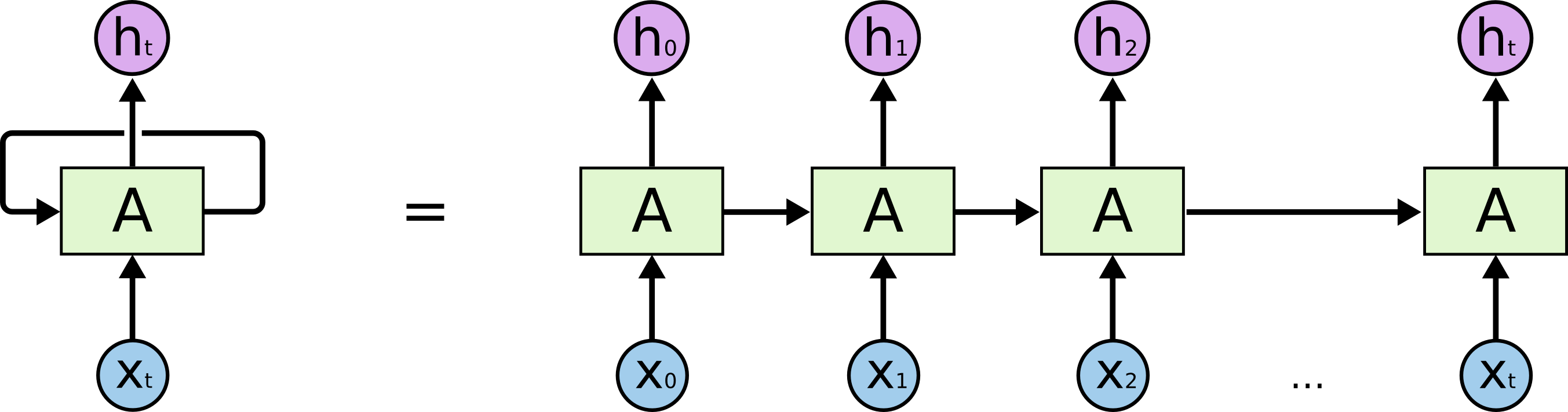

순환 신경망 (RNN) 소개 | 67일차

순서가 있는 데이터를 처리하는 데 효과적인 순환 신경망(RNN)의 기본 구조와 원리에 대해 학습했습니다. 자세히 보기

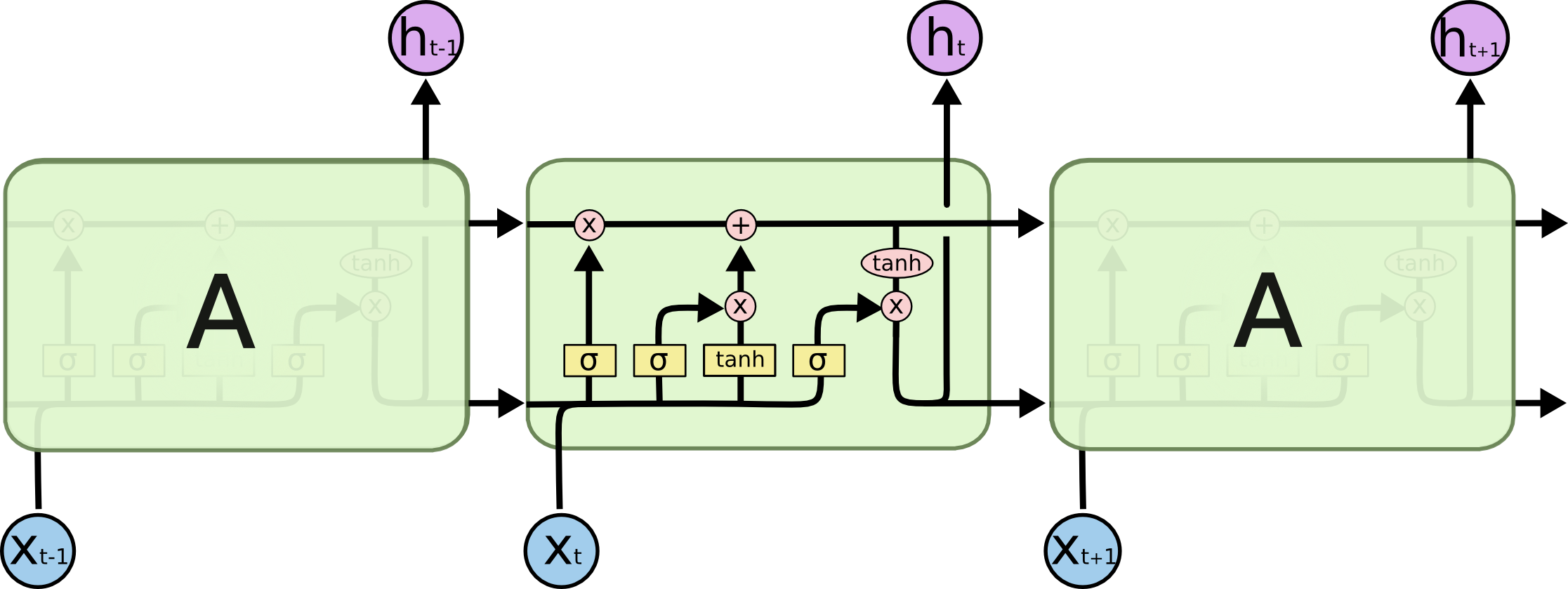

LSTM (Long Short-Term Memory) 네트워크 | 68일차

RNN의 장기 의존성 문제를 해결하기 위해 제안된 LSTM 네트워크에 대해 학습했습니다. 자세히 보기

RNN/LSTM을 이용한 텍스트 분류기 구축 | 69일차

RNN 또는 LSTM을 사용하여 텍스트 분류기를 구축하는 방법을 학습했습니다. 코드

강화 학습 및 NLP 개념 복습 | 70일차

지난 15일간 학습한 강화 학습 및 자연어 처리 관련 주요 개념들을 복습했습니다. 자세히 보기

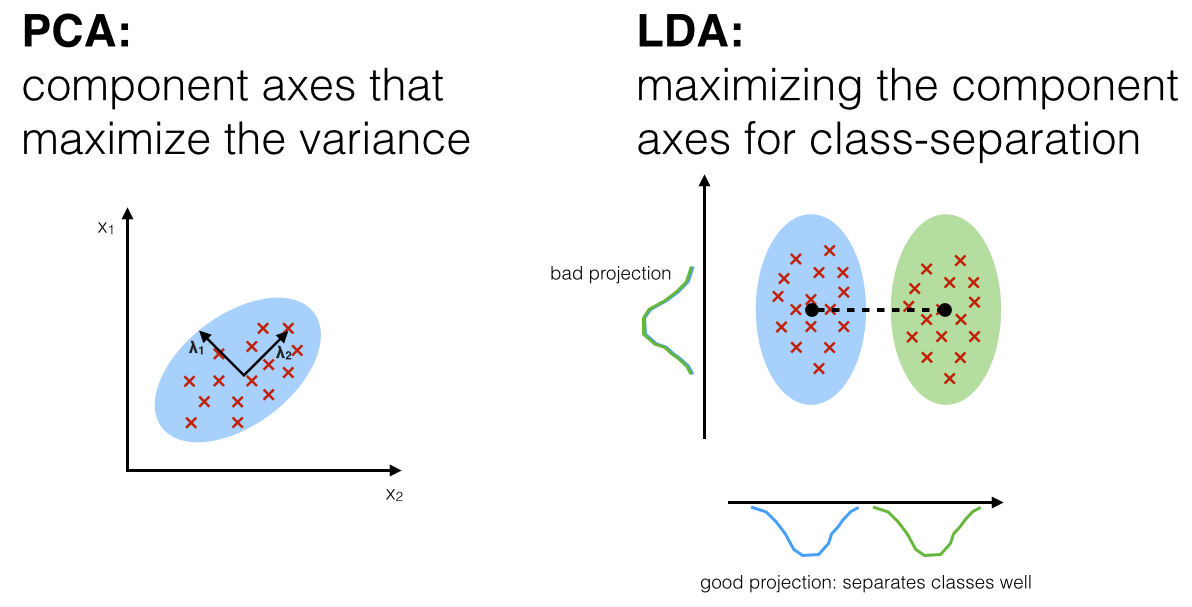

주성분 분석 (PCA) - 이론 및 구현 | 71일차

차원 축소 기법 중 하나인 주성분 분석(PCA)의 이론을 학습하고 구현했습니다. 코드

선형 판별 분석 (LDA) | 72일차

또 다른 차원 축소 및 분류 기법인 선형 판별 분석(LDA)에 대해 학습했습니다. 코드

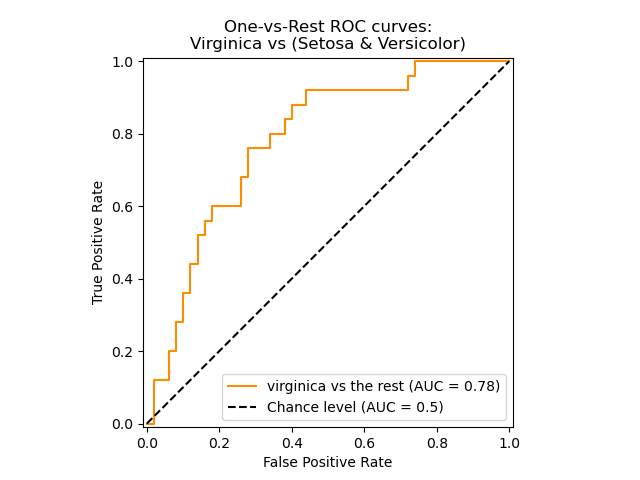

모델 평가 지표 | 73일차

머신러닝 모델의 성능을 평가하기 위한 다양한 지표(정밀도, 재현율, F1 점수, ROC AUC)에 대해 학습했습니다. 자세히 보기

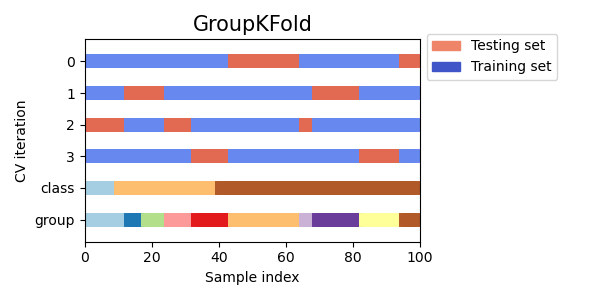

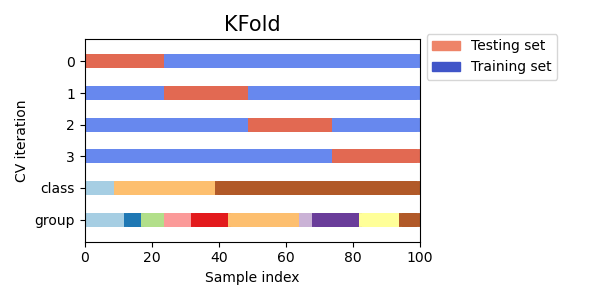

교차 검증 기법 | 74일차

모델의 일반화 성능을 평가하기 위한 교차 검증 기법(K-폴드 교차 검증 등)에 대해 학습했습니다. 자세히 보기

하이퍼파라미터 튜닝 | 75일차

모델 성능을 최적화하기 위한 하이퍼파라미터 튜닝 방법(그리드 서치, 랜덤 서치)에 대해 학습했습니다. 자세히 보기

앙상블 방법 - 배깅, 부스팅 | 76일차

여러 모델을 결합하여 성능을 향상시키는 앙상블 기법 중 배깅(랜덤 포레스트 복습)과 부스팅(AdaBoost, Gradient Boosting)에 대해 학습했습니다. 코드

XGBoost - 소개 및 구현 | 77일차

강력한 부스팅 알고리즘인 XGBoost의 개념을 학습하고 구현했습니다. 코드

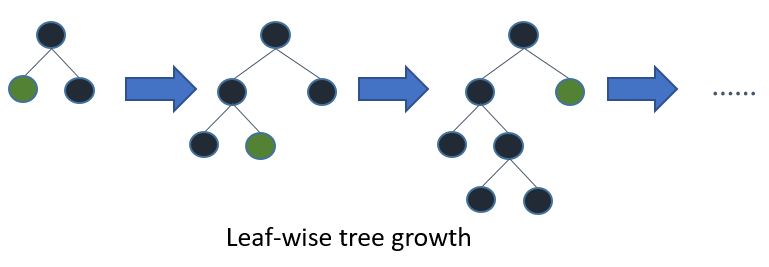

LightGBM - 소개 및 구현 | 78일차

XGBoost와 유사하지만 더 빠르고 효율적인 LightGBM에 대해 학습하고 구현했습니다. 코드

시계열 분석 소개 | 79일차

시간 순서대로 기록된 데이터인 시계열 데이터 분석의 기초 개념을 학습했습니다. 자세히 보기

시계열을 위한 ARIMA 모델 | 80일차

대표적인 시계열 예측 모델인 ARIMA 모델에 대해 학습하고 간단한 예제에 적용해 보았습니다. 코드

모델 배포 소개 | 81일차

개발한 머신러닝 모델을 실제 환경에서 사용할 수 있도록 배포하는 과정의 중요성과 기본 개념을 학습했습니다. 자세히 보기

ML 모델 배포를 위한 Flask/Django - 기초 | 82일차

웹 프레임워크인 Flask 또는 Django를 사용하여 머신러닝 모델을 배포하는 기초적인 방법을 학습했습니다. 자세히 보기

ML 모델을 위한 간단한 API 만들기 | 83일차

Flask/Django를 사용하여 학습된 머신러닝 모델을 위한 간단한 API를 만드는 실습을 진행했습니다. 코드

ML을 위한 Docker - 기초 | 84일차

컨테이너화 기술인 Docker를 머신러닝 모델 배포에 활용하는 기초적인 방법을 학습했습니다. 자세히 보기

Docker를 사용한 간단한 ML 모델 배포 | 85일차

Docker를 사용하여 간단한 머신러닝 모델을 배포하는 실습을 진행했습니다. 코드

캡스톤 프로젝트 아이디어 브레인스토밍 | 86일차

100일 챌린지를 마무리할 캡스톤 프로젝트에 대한 아이디어를 구상했습니다. 자세히 보기

캡스톤 프로젝트 선정 및 범위 정의 | 87일차

여러 아이디어 중 하나를 캡스톤 프로젝트로 선정하고, 프로젝트의 목표와 범위를 명확히 정의했습니다. 자세히 보기

프로젝트를 위한 데이터 수집 및 전처리 | 88일차

캡스톤 프로젝트에 필요한 데이터를 수집하고, 모델 학습에 적합하도록 전처리하는 작업을 수행했습니다. 자세히 보기

프로젝트를 위한 탐색적 데이터 분석 (EDA) | 89일차

수집된 데이터를 다양한 각도에서 분석하고 시각화하여 데이터의 특징과 패턴을 파악하는 EDA를 수행했습니다. 자세히 보기

프로젝트를 위한 모델 선정 및 초기 학습 | 90일차

프로젝트 목표에 맞는 머신러닝 모델을 선정하고, 전처리된 데이터를 사용하여 초기 모델 학습을 진행했습니다. 자세히 보기

프로젝트를 위한 모델 평가 및 반복 | 91일차

학습된 모델의 성능을 평가하고, 문제점을 분석하여 모델을 개선하는 반복 작업을 수행했습니다. 자세히 보기

프로젝트를 위한 미세 조정 및 최적화 | 92일차

선정된 모델의 하이퍼파라미터를 조정하고 다양한 최적화 기법을 적용하여 모델 성능을 극대화했습니다. 자세히 보기

프로젝트를 위한 간단한 UI 또는 프레젠테이션 구축 | 93일차

캡스톤 프로젝트의 결과를 효과적으로 보여줄 수 있는 간단한 사용자 인터페이스(UI) 또는 프레젠테이션 자료를 제작했습니다. 자세히 보기

캡스톤 프로젝트 문서화 | 94일차

프로젝트의 전 과정(데이터 수집, 전처리, 모델링, 평가, 결과)을 상세히 기록하여 문서화했습니다. 자세히 보기

생성적 적대 신경망 (GAN) 소개 | 95일차

새로운 데이터를 생성하는 모델인 생성적 적대 신경망(GAN)의 기본 개념과 작동 원리에 대해 학습했습니다. 자세히 보기

오토인코더 | 96일차

데이터의 특징을 효율적으로 학습하여 차원 축소나 이상치 탐지 등에 활용되는 오토인코더에 대해 학습했습니다. 자세히 보기

설명 가능한 AI (XAI) - LIME, SHAP | 97일차

머신러닝 모델의 예측 결과를 사람이 이해할 수 있도록 설명하는 XAI 기법(LIME, SHAP 등)에 대해 학습했습니다. 자세히 보기

AI 및 머신러닝 윤리 | 98일차

인공지능 기술 발전과 함께 중요성이 커지고 있는 AI 및 머신러닝 윤리 문제에 대해 고찰했습니다. 자세히 보기

ML 및 AI의 미래 동향 | 99일차

머신러닝과 인공지능 분야의 최신 연구 동향과 미래 발전 가능성에 대해 학습하고 토론했습니다. 자세히 보기

100일 여정 복습 및 다음 단계 | 100일차

지난 100일간의 머신러닝 학습 여정을 되돌아보고, 앞으로의 학습 계획 및 목표를 설정했습니다. 자세히 보기

데이터 전처리

인포그래픽에 표시된 것처럼 데이터 전처리를 6가지 필수 단계로 나눕니다. 이 예제에 사용된 데이터셋은 여기에서 가져오세요.

1단계: 라이브러리 가져오기

import numpy as np

import pandas as pd

2단계: 데이터셋 가져오기

dataset = pd.read_csv('Data.csv')

X = dataset.iloc[ : , :-1].values # 종속 변수를 제외한 모든 열 선택

Y = dataset.iloc[ : , 3].values # 종속 변수 열 선택

3단계: 누락된 데이터 처리

from sklearn.preprocessing import Imputer

imputer = Imputer(missing_values = "NaN", strategy = "mean", axis = 0) # 누락된 값을 평균으로 대체

imputer = imputer.fit(X[ : , 1:3]) # 숫자형 열에 대해 imputer 학습

X[ : , 1:3] = imputer.transform(X[ : , 1:3]) # 누락된 값 변환

4단계: 범주형 데이터 인코딩

from sklearn.preprocessing import LabelEncoder, OneHotEncoder

labelencoder_X = LabelEncoder()

X[ : , 0] = labelencoder_X.fit_transform(X[ : , 0]) # 첫 번째 열(국가)을 숫자로 인코딩

더미 변수 만들기

onehotencoder = OneHotEncoder(categorical_features = [0]) # 첫 번째 열을 원-핫 인코딩

X = onehotencoder.fit_transform(X).toarray()

labelencoder_Y = LabelEncoder()

Y = labelencoder_Y.fit_transform(Y) # 종속 변수(구매 여부)를 숫자로 인코딩

5단계: 데이터셋을 훈련 세트와 테스트 세트로 분할

from sklearn.cross_validation import train_test_split

X_train, X_test, Y_train, Y_test = train_test_split( X , Y , test_size = 0.2, random_state = 0) # 80% 훈련, 20% 테스트

6단계: 특징 스케일링

from sklearn.preprocessing import StandardScaler

sc_X = StandardScaler()

X_train = sc_X.fit_transform(X_train) # 훈련 세트에 대해 스케일러 학습 및 변환

X_test = sc_X.transform(X_test) # 테스트 세트에 대해 학습된 스케일러로 변환 (fit_transform 아님)

완료 :smile:

단순 선형 회귀

1단계: 데이터 전처리

import pandas as pd

import numpy as np

import matplotlib.pyplot as plt

dataset = pd.read_csv('studentscores.csv')

X = dataset.iloc[ : , : 1 ].values # 독립 변수 (학습 시간)

Y = dataset.iloc[ : , 1 ].values # 종속 변수 (점수)

from sklearn.cross_validation import train_test_split

X_train, X_test, Y_train, Y_test = train_test_split( X, Y, test_size = 1/4, random_state = 0) # 75% 훈련, 25% 테스트

2단계: 훈련 세트에 단순 선형 회귀 모델 피팅

from sklearn.linear_model import LinearRegression

regressor = LinearRegression()

regressor = regressor.fit(X_train, Y_train) # 훈련 데이터로 모델 학습

3단계: 결과 예측

Y_pred = regressor.predict(X_test) # 테스트 데이터로 예측

4단계: 시각화

훈련 결과 시각화

plt.scatter(X_train , Y_train, color = 'red') # 실제 훈련 데이터 점

plt.plot(X_train , regressor.predict(X_train), color ='blue') # 훈련 데이터에 대한 예측 선

테스트 결과 시각화

plt.scatter(X_test , Y_test, color = 'red') # 실제 테스트 데이터 점

plt.plot(X_test , regressor.predict(X_test), color ='blue') # 테스트 데이터에 대한 예측 선 (X_train에 대한 예측 선과 동일해야 함)

다중 선형 회귀

1단계: 데이터 전처리

라이브러리 가져오기

import pandas as pd

import numpy as np

데이터셋 가져오기

dataset = pd.read_csv('50_Startups.csv')

X = dataset.iloc[ : , :-1].values # 독립 변수 (R&D 지출, 관리비, 마케팅 지출, 주)

Y = dataset.iloc[ : , 4 ].values # 종속 변수 (수익)

범주형 데이터 인코딩

from sklearn.preprocessing import LabelEncoder, OneHotEncoder

labelencoder = LabelEncoder()

X[: , 3] = labelencoder.fit_transform(X[ : , 3]) # '주' 열을 숫자로 인코딩

onehotencoder = OneHotEncoder(categorical_features = [3]) # '주' 열을 원-핫 인코딩

X = onehotencoder.fit_transform(X).toarray()

더미 변수 함정 피하기

X = X[: , 1:] # 첫 번째 더미 변수 열을 제거하여 다중공선성 방지

데이터셋을 훈련 세트와 테스트 세트로 분할

from sklearn.cross_validation import train_test_split

X_train, X_test, Y_train, Y_test = train_test_split(X, Y, test_size = 0.2, random_state = 0) # 80% 훈련, 20% 테스트

2단계: 훈련 세트에 다중 선형 회귀 피팅

from sklearn.linear_model import LinearRegression

regressor = LinearRegression()

regressor.fit(X_train, Y_train) # 훈련 데이터로 모델 학습

3단계: 테스트 세트 결과 예측

y_pred = regressor.predict(X_test) # 테스트 데이터로 예측

로지스틱 회귀

데이터셋 | 소셜 네트워크

이 데이터셋에는 소셜 네트워크 사용자 정보가 포함되어 있습니다. 이 정보는 사용자 ID, 성별, 나이 및 예상 급여입니다. 한 자동차 회사가 새로운 고급 SUV를 출시했습니다. 그리고 우리는 이 소셜 네트워크 사용자 중 누가 이 새로운 SUV를 구매할 것인지 확인하려고 합니다. 그리고 여기 마지막 열은 사용자가 이 SUV를 구매했는지 여부를 나타냅니다. 우리는 두 가지 변수, 즉 나이와 예상 급여를 기반으로 사용자가 SUV를 구매할지 여부를 예측하는 모델을 구축할 것입니다. 따라서 우리의 특징 행렬은 이 두 열만 해당됩니다. 우리는 사용자의 나이와 예상 급여, 그리고 SUV 구매 결정(예 또는 아니오) 사이의 상관 관계를 찾고 싶습니다.

1단계 | 데이터 전처리

라이브러리 가져오기

import numpy as np

import matplotlib.pyplot as plt

import pandas as pd

데이터셋 가져오기

여기에서 데이터셋을 가져오세요.

dataset = pd.read_csv('Social_Network_Ads.csv')

X = dataset.iloc[:, [2, 3]].values # 독립 변수 (나이, 예상 급여)

y = dataset.iloc[:, 4].values # 종속 변수 (구매 여부)

데이터셋을 훈련 세트와 테스트 세트로 분할

from sklearn.cross_validation import train_test_split

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size = 0.25, random_state = 0) # 75% 훈련, 25% 테스트

특징 스케일링

from sklearn.preprocessing import StandardScaler

sc = StandardScaler()

X_train = sc.fit_transform(X_train) # 훈련 세트에 스케일러 학습 및 적용

X_test = sc.transform(X_test) # 테스트 세트에 학습된 스케일러 적용

2단계 | 로지스틱 회귀 모델

이 작업에 사용할 라이브러리는 선형 모델 라이브러리이며 로지스틱 회귀가 선형 분류기이기 때문에 선형이라고 불립니다. 즉, 여기서는 2차원이므로 두 사용자 범주는 직선으로 구분됩니다. 그런 다음 로지스틱 회귀 클래스를 가져옵니다. 다음으로 이 클래스에서 새 객체를 만들 것인데, 이 객체는 훈련 세트에 적합시킬 분류기가 됩니다.

훈련 세트에 로지스틱 회귀 피팅

from sklearn.linear_model import LogisticRegression

classifier = LogisticRegression() # random_state는 필요에 따라 추가 가능

classifier.fit(X_train, y_train)

3단계 | 예측

테스트 세트 결과 예측

y_pred = classifier.predict(X_test)

4단계 | 예측 평가

테스트 결과를 예측했으며 이제 로지스틱 회귀 모델이 올바르게 학습하고 이해했는지 평가할 것입니다. 따라서 이 혼동 행렬에는 모델이 세트에서 수행한 올바른 예측과 잘못된 예측이 포함됩니다.

혼동 행렬 만들기

from sklearn.metrics import confusion_matrix

cm = confusion_matrix(y_test, y_pred)

시각화

K-최근접 이웃 (K-NN)

데이터셋 | 소셜 네트워크

라이브러리 가져오기

import numpy as np

import matplotlib.pyplot as plt

import pandas as pd

데이터셋 가져오기

dataset = pd.read_csv('Social_Network_Ads.csv')

X = dataset.iloc[:, [2, 3]].values

y = dataset.iloc[:, 4].values

데이터셋을 훈련 세트와 테스트 세트로 분할

from sklearn.cross_validation import train_test_split

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size = 0.25, random_state = 0)

특징 스케일링

from sklearn.preprocessing import StandardScaler

sc = StandardScaler()

X_train = sc.fit_transform(X_train)

X_test = sc.transform(X_test)

훈련 세트에 K-NN 피팅

from sklearn.neighbors import KNeighborsClassifier

classifier = KNeighborsClassifier(n_neighbors = 5, metric = 'minkowski', p = 2) # n_neighbors: 이웃 수, metric: 거리 측정 방식, p: 민코프스키 거리의 파라미터 (2는 유클리드 거리)

classifier.fit(X_train, y_train)

테스트 세트 결과 예측

y_pred = classifier.predict(X_test)

혼동 행렬 만들기

from sklearn.metrics import confusion_matrix

cm = confusion_matrix(y_test, y_pred)

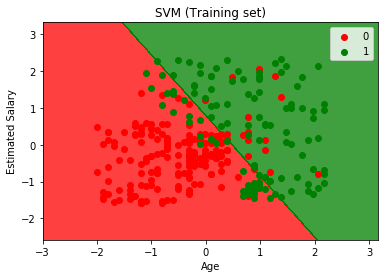

13일차 | 서포트 벡터 머신 (SVM)

라이브러리 가져오기

import numpy as np

import matplotlib.pyplot as plt

import pandas as pd

데이터셋 가져오기

dataset = pd.read_csv('Social_Network_Ads.csv')

X = dataset.iloc[:, [2, 3]].values

y = dataset.iloc[:, 4].values

데이터셋을 훈련 세트와 테스트 세트로 분할

from sklearn.cross_validation import train_test_split

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size = 0.25, random_state = 0)

특징 스케일링

from sklearn.preprocessing import StandardScaler

sc = StandardScaler()

X_train = sc.fit_transform(X_train)

X_test = sc.fit_transform(X_test) # 참고: 여기서는 fit_transform 대신 transform을 사용해야 합니다. 테스트 세트에서는 훈련 세트에서 학습한 스케일링을 그대로 적용해야 합니다.

훈련 세트에 SVM 피팅

from sklearn.svm import SVC

classifier = SVC(kernel = 'linear', random_state = 0) # kernel: 사용할 커널 함수 ('linear'는 선형 커널), random_state: 난수 시드

classifier.fit(X_train, y_train)

테스트 세트 결과 예측

y_pred = classifier.predict(X_test)

혼동 행렬 만들기

from sklearn.metrics import confusion_matrix

cm = confusion_matrix(y_test, y_pred)

훈련 세트 결과 시각화

from matplotlib.colors import ListedColormap

X_set, y_set = X_train, y_train

X1, X2 = np.meshgrid(np.arange(start = X_set[:, 0].min() - 1, stop = X_set[:, 0].max() + 1, step = 0.01),

np.arange(start = X_set[:, 1].min() - 1, stop = X_set[:, 1].max() + 1, step = 0.01))

plt.contourf(X1, X2, classifier.predict(np.array([X1.ravel(), X2.ravel()]).T).reshape(X1.shape),

alpha = 0.75, cmap = ListedColormap(('red', 'green')))

plt.xlim(X1.min(), X1.max())

plt.ylim(X2.min(), X2.max())

for i, j in enumerate(np.unique(y_set)):

plt.scatter(X_set[y_set == j, 0], X_set[y_set == j, 1],

c = ListedColormap(('red', 'green'))(i), label = j)

plt.title('SVM (훈련 세트)')

plt.xlabel('나이')

plt.ylabel('예상 급여')

plt.legend()

plt.show()

테스트 세트 결과 시각화

from matplotlib.colors import ListedColormap

X_set, y_set = X_test, y_test

X1, X2 = np.meshgrid(np.arange(start = X_set[:, 0].min() - 1, stop = X_set[:, 0].max() + 1, step = 0.01),

np.arange(start = X_set[:, 1].min() - 1, stop = X_set[:, 1].max() + 1, step = 0.01))

plt.contourf(X1, X2, classifier.predict(np.array([X1.ravel(), X2.ravel()]).T).reshape(X1.shape),

alpha = 0.75, cmap = ListedColormap(('red', 'green')))

plt.xlim(X1.min(), X1.max())

plt.ylim(X2.min(), X2.max())

for i, j in enumerate(np.unique(y_set)):

plt.scatter(X_set[y_set == j, 0], X_set[y_set == j, 1],

c = ListedColormap(('red', 'green'))(i), label = j)

plt.title('SVM (테스트 세트)')

plt.xlabel('나이')

plt.ylabel('예상 급여')

plt.legend()

plt.show()

결정 트리 분류

라이브러리 가져오기

import numpy as np

import matplotlib.pyplot as plt

import pandas as pd

데이터셋 가져오기

dataset = pd.read_csv('Social_Network_Ads.csv')

X = dataset.iloc[:, [2, 3]].values # 독립 변수 (나이, 예상 급여)

y = dataset.iloc[:, 4].values # 종속 변수 (구매 여부)

데이터셋을 훈련 세트와 테스트 세트로 분할

from sklearn.cross_validation import train_test_split

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size = 0.25, random_state = 0) # 75% 훈련, 25% 테스트

특징 스케일링

from sklearn.preprocessing import StandardScaler

sc = StandardScaler()

X_train = sc.fit_transform(X_train) # 훈련 세트에 스케일러 학습 및 적용

X_test = sc.transform(X_test) # 테스트 세트에 학습된 스케일러 적용

훈련 세트에 결정 트리 분류 피팅

from sklearn.tree import DecisionTreeClassifier

classifier = DecisionTreeClassifier(criterion = 'entropy', random_state = 0) # criterion: 분할 품질 측정 기준 ('entropy'는 정보 이득), random_state: 난수 시드

classifier.fit(X_train, y_train)

테스트 세트 결과 예측

y_pred = classifier.predict(X_test)

혼동 행렬 만들기

from sklearn.metrics import confusion_matrix

cm = confusion_matrix(y_test, y_pred)

훈련 세트 결과 시각화

from matplotlib.colors import ListedColormap

X_set, y_set = X_train, y_train

X1, X2 = np.meshgrid(np.arange(start = X_set[:, 0].min() - 1, stop = X_set[:, 0].max() + 1, step = 0.01),

np.arange(start = X_set[:, 1].min() - 1, stop = X_set[:, 1].max() + 1, step = 0.01))

plt.contourf(X1, X2, classifier.predict(np.array([X1.ravel(), X2.ravel()]).T).reshape(X1.shape),

alpha = 0.75, cmap = ListedColormap(('red', 'green')))

plt.xlim(X1.min(), X1.max())

plt.ylim(X2.min(), X2.max())

for i, j in enumerate(np.unique(y_set)):

plt.scatter(X_set[y_set == j, 0], X_set[y_set == j, 1],

c = ListedColormap(('red', 'green'))(i), label = j)

plt.title('결정 트리 분류 (훈련 세트)')

plt.xlabel('나이')

plt.ylabel('예상 급여')

plt.legend()

plt.show()

테스트 세트 결과 시각화

from matplotlib.colors import ListedColormap

X_set, y_set = X_test, y_test

X1, X2 = np.meshgrid(np.arange(start = X_set[:, 0].min() - 1, stop = X_set[:, 0].max() + 1, step = 0.01),

np.arange(start = X_set[:, 1].min() - 1, stop = X_set[:, 1].max() + 1, step = 0.01))

plt.contourf(X1, X2, classifier.predict(np.array([X1.ravel(), X2.ravel()]).T).reshape(X1.shape),

alpha = 0.75, cmap = ListedColormap(('red', 'green')))

plt.xlim(X1.min(), X1.max())

plt.ylim(X2.min(), X2.max())

for i, j in enumerate(np.unique(y_set)):

plt.scatter(X_set[y_set == j, 0], X_set[y_set == j, 1],

c = ListedColormap(('red', 'green'))(i), label = j)

plt.title('결정 트리 분류 (테스트 세트)')

plt.xlabel('나이')

plt.ylabel('예상 급여')

plt.legend()

plt.show()

랜덤 포레스트

라이브러리 가져오기

import numpy as np

import matplotlib.pyplot as plt

import pandas as pd

데이터셋 가져오기

dataset = pd.read_csv('Social_Network_Ads.csv')

X = dataset.iloc[:, [2, 3]].values # 독립 변수 (나이, 예상 급여)

y = dataset.iloc[:, 4].values # 종속 변수 (구매 여부)

데이터셋을 훈련 세트와 테스트 세트로 분할

from sklearn.cross_validation import train_test_split

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size = 0.25, random_state = 0) # 75% 훈련, 25% 테스트

특징 스케일링

from sklearn.preprocessing import StandardScaler

sc = StandardScaler()

X_train = sc.fit_transform(X_train) # 훈련 세트에 스케일러 학습 및 적용

X_test = sc.transform(X_test) # 테스트 세트에 학습된 스케일러 적용

훈련 세트에 랜덤 포레스트 피팅

from sklearn.ensemble import RandomForestClassifier

classifier = RandomForestClassifier(n_estimators = 10, criterion = 'entropy', random_state = 0) # n_estimators: 트리의 개수, criterion: 분할 품질 측정 기준 ('entropy'는 정보 이득), random_state: 난수 시드

classifier.fit(X_train, y_train)

테스트 세트 결과 예측

y_pred = classifier.predict(X_test)

혼동 행렬 만들기

from sklearn.metrics import confusion_matrix

cm = confusion_matrix(y_test, y_pred)

훈련 세트 결과 시각화

from matplotlib.colors import ListedColormap

X_set, y_set = X_train, y_train

X1, X2 = np.meshgrid(np.arange(start = X_set[:, 0].min() - 1, stop = X_set[:, 0].max() + 1, step = 0.01),

np.arange(start = X_set[:, 1].min() - 1, stop = X_set[:, 1].max() + 1, step = 0.01))

plt.contourf(X1, X2, classifier.predict(np.array([X1.ravel(), X2.ravel()]).T).reshape(X1.shape),

alpha = 0.75, cmap = ListedColormap(('red', 'green')))

plt.xlim(X1.min(), X1.max())

plt.ylim(X2.min(), X2.max())

for i, j in enumerate(np.unique(y_set)):

plt.scatter(X_set[y_set == j, 0], X_set[y_set == j, 1],

c = ListedColormap(('red', 'green'))(i), label = j)

plt.title('랜덤 포레스트 분류 (훈련 세트)')

plt.xlabel('나이')

plt.ylabel('예상 급여')

plt.legend()

plt.show()

테스트 세트 결과 시각화

from matplotlib.colors import ListedColormap

X_set, y_set = X_test, y_test

X1, X2 = np.meshgrid(np.arange(start = X_set[:, 0].min() - 1, stop = X_set[:, 0].max() + 1, step = 0.01),

np.arange(start = X_set[:, 1].min() - 1, stop = X_set[:, 1].max() + 1, step = 0.01))

plt.contourf(X1, X2, classifier.predict(np.array([X1.ravel(), X2.ravel()]).T).reshape(X1.shape),

alpha = 0.75, cmap = ListedColormap(('red', 'green')))

plt.xlim(X1.min(), X1.max())

plt.ylim(X2.min(), X2.max())

for i, j in enumerate(np.unique(y_set)):

plt.scatter(X_set[y_set == j, 0], X_set[y_set == j, 1],

c = ListedColormap(('red', 'green'))(i), label = j)

plt.title('랜덤 포레스트 분류 (테스트 세트)')

plt.xlabel('나이')

plt.ylabel('예상 급여')

plt.legend()

plt.show()

Day 55: 강화 학습 소개 (Introduction to Reinforcement Learning)

학습 목표

- 강화 학습(RL)의 기본 개념 이해

- RL의 주요 용어(에이전트, 환경, 상태, 행동, 보상, 정책, 가치 함수, 모델) 숙지

핵심 개념

1. 강화 학습 (Reinforcement Learning)

- 에이전트(Agent)가 환경(Environment)과 상호작용하며 학습하는 머신러닝의 한 분야입니다.

- 에이전트는 현재 상태(State)를 관찰하고 행동(Action)을 선택합니다.

- 환경은 에이전트의 행동에 따라 다음 상태로 전이되고 보상(Reward)을 에이전트에게 제공합니다.

- 에이전트의 목표는 누적 보상을 최대화하는 정책(Policy)을 학습하는 것입니다.

2. 주요 구성 요소

- **에이전트 (Agent)**: 학습의 주체. 환경을 관찰하고, 행동을 결정하며, 보상을 통해 학습합니다.

- **환경 (Environment)**: 에이전트가 상호작용하는 외부 세계. 에이전트의 행동에 따라 상태가 변하고 보상을 제공합니다.

- **상태 (State, S)**: 특정 시점에서 환경에 대한 관찰 가능한 정보. 에이전트가 행동을 결정하는 데 사용됩니다. (예: 게임 화면, 로봇 센서 값)

- **행동 (Action, A)**: 에이전트가 특정 상태에서 취할 수 있는 움직임이나 결정. (예: 게임 캐릭터의 이동, 로봇 팔의 움직임)

- **보상 (Reward, R)**: 에이전트가 특정 행동을 취했을 때 환경으로부터 받는 피드백. 즉각적인 좋고 나쁨을 나타내는 스칼라 값입니다. (예: 게임 점수 획득(+), 장애물 충돌(-))

- **정책 (Policy, π)**: 특정 상태에서 에이전트가 어떤 행동을 선택할지에 대한 전략 또는 규칙. 상태를 행동으로 매핑하는 함수로 표현될 수 있습니다. (π(a|s) = P[A_t = a | S_t = s])

- **가치 함수 (Value Function, V, Q)**: 특정 상태 또는 특정 상태-행동 쌍의 장기적인 가치를 평가하는 함수. 미래에 받을 누적 보상의 기댓값으로 정의됩니다.

- 상태 가치 함수 V(s): 상태 s에서 시작하여 특정 정책 π를 따랐을 때 받을 수 있는 누적 보상의 기댓값.

- 행동 가치 함수 Q(s, a): 상태 s에서 행동 a를 취하고 이후 특정 정책 π를 따랐을 때 받을 수 있는 누적 보상의 기댓값.

- **모델 (Model)** (선택 사항): 환경이 어떻게 작동하는지에 대한 에이전트의 표현. 상태 전이 확률과 보상 함수를 포함할 수 있습니다.

- 모델 기반 RL: 환경의 모델을 학습하거나 알고 있는 경우.

- 모델 프리 RL: 환경의 모델 없이 학습하는 경우.

3. 강화 학습의 목표

- 에이전트가 장기적으로 받는 누적 보상(Cumulative Reward)을 최대화하는 최적의 정책(Optimal Policy, π*)을 찾는 것입니다.

추가 학습 자료

다음 학습 내용

- Day 56: 마르코프 결정 과정 (Markov Decision Processes)

Day 56: 마르코프 결정 과정 (Markov Decision Processes, MDPs)

학습 목표

- 마르코프 결정 과정(MDP)의 정의와 구성 요소 이해

- MDP가 강화 학습 문제를 형식화하는 데 어떻게 사용되는지 이해

- 벨만 방정식(Bellman Equation)의 기본 개념 학습

핵심 개념

1. 마르코프 결정 과정 (MDP)

- 강화 학습 문제를 수학적으로 모델링하기 위한 프레임워크입니다.

- 순차적 의사 결정 문제를 다루며, 현재 상태가 주어지면 과거의 상태와 무관하게 미래의 상태 전이가 결정되는 마르코프 속성(Markov Property)을 가정합니다.

- MDP는 다음의 튜플로 정의됩니다: (S, A, P, R, γ)

- S (States): 가능한 모든 상태의 유한 집합. (어제 학습한 내용)

- A (Actions): 가능한 모든 행동의 유한 집합. (어제 학습한 내용)

- P (Transition Probability Function, P(s’|s, a)): 상태 s에서 행동 a를 취했을 때 다음 상태 s’로 전이될 확률. P(s’|s, a) = P[S_{t+1} = s’ | S_t = s, A_t = a]

- R (Reward Function, R(s, a, s’)): 상태 s에서 행동 a를 취하여 상태 s’로 전이했을 때 받는 즉각적인 보상. 때로는 R(s, a) 또는 R(s)로 단순화하여 표현하기도 합니다.

- γ (Discount Factor, 감가율): 0과 1 사이의 값으로, 미래 보상의 현재 가치를 나타냅니다. γ가 0에 가까우면 단기적인 보상에 집중하고, 1에 가까우면 장기적인 보상까지 고려합니다.

2. 마르코프 속성 (Markov Property)

- “미래는 과거와 독립적으로 현재에만 의존한다.”

- 특정 시점 t+1에서의 상태 S_{t+1}과 보상 R_{t+1}은, 바로 이전 시점 t에서의 상태 S_t와 행동 A_t에만 의존하고, 그 이전의 모든 상태와 행동 이력과는 무관하다는 성질입니다.

- P[S_{t+1} | S_t, A_t, S_{t-1}, A_{t-1}, …, S_0, A_0] = P[S_{t+1} | S_t, A_t]

3. 정책 (Policy, π)

- MDP에서 에이전트가 각 상태에서 어떤 행동을 선택할지를 결정하는 규칙입니다.

- 결정론적 정책(Deterministic Policy): π(s) = a (상태 s에서 항상 행동 a를 선택)

- 확률론적 정책(Stochastic Policy): π(a|s) = P[A_t = a | S_t = s] (상태 s에서 행동 a를 선택할 확률)

4. 가치 함수 (Value Function)

- 정책 π를 따랐을 때 각 상태 또는 상태-행동 쌍이 얼마나 좋은지를 나타내는 함수입니다.

- 상태 가치 함수 (State-Value Function, Vπ(s)): 상태 s에서 시작하여 정책 π를 따랐을 때 얻을 수 있는 총 감가된 보상의 기댓값. Vπ(s) = Eπ[Gt | St = s] = Eπ[∑k=0∞ γkRt+k+1 | St = s]

- 행동 가치 함수 (Action-Value Function, Qπ(s, a)): 상태 s에서 행동 a를 취하고 이후 정책 π를 따랐을 때 얻을 수 있는 총 감가된 보상의 기댓값. Qπ(s, a) = Eπ[Gt | St = s, At = a] = Eπ[∑k=0∞ γkRt+k+1 | St = s, At = a]

5. 벨만 방정식 (Bellman Equation)

- 가치 함수들 사이의 관계를 나타내는 방정식으로, 현재 상태의 가치와 다음 상태의 가치 사이의 관계를 재귀적으로 표현합니다.

- 강화 학습 알고리즘의 핵심적인 기반이 됩니다.

- 벨만 기대 방정식 (Bellman Expectation Equation) for Vπ: Vπ(s) = ∑a π(a|s) ∑s’ P(s’|s, a) [R(s, a, s’) + γVπ(s’)]

- 벨만 기대 방정식 (Bellman Expectation Equation) for Qπ: Qπ(s, a) = ∑s’ P(s’|s, a) [R(s, a, s’) + γ∑a’ π(a’|s’)Qπ(s’, a’)]

- 벨만 최적 방정식 (Bellman Optimality Equation): 최적 가치 함수 V*(s)와 Q*(s,a)에 대한 방정식.

- V*(s) = maxa ∑s’ P(s’|s, a) [R(s, a, s’) + γV*(s’)]

- Q*(s, a) = ∑s’ P(s’|s, a) [R(s, a, s’) + γmaxa’Q*(s’, a’)]

추가 학습 자료

다음 학습 내용

- Day 57: Q-러닝 - 이론 및 알고리즘 (Q-Learning - Theory and Algorithm)

Day 57: Q-러닝 - 이론 및 알고리즘 (Q-Learning - Theory and Algorithm)

학습 목표

- Q-러닝의 개념과 중요성 이해

- Q-러닝이 모델 프리(Model-Free) 및 오프 폴리시(Off-Policy) 알고리즘인 이유 이해

- Q-러닝 업데이트 규칙 학습

핵심 개념

1. Q-러닝 (Q-Learning)

- 대표적인 모델 프리(Model-Free), 오프 폴리시(Off-Policy) 강화 학습 알고리즘입니다.

- 환경의 모델(상태 전이 확률, 보상 함수)을 알지 못해도 최적의 행동 가치 함수(Optimal Action-Value Function, Q*)를 학습할 수 있습니다.

- Q*를 학습함으로써 에이전트는 각 상태에서 어떤 행동을 취해야 누적 보상을 최대로 얻을 수 있는지 알게 됩니다.

2. 모델 프리 (Model-Free)

- 환경의 모델 P(s’|s, a) 및 R(s, a, s’)을 직접적으로 사용하거나 추정하지 않습니다.

- 대신, 에이전트가 환경과 직접 상호작용하며 얻는 경험(샘플)로부터 가치 함수를 학습합니다. (예: (s, a, r, s’) 튜플)

3. 오프 폴리시 (Off-Policy)

- 에이전트가 행동을 선택하는 데 사용하는 정책(행동 정책, Behavior Policy)과 평가하고 개선하려는 정책(타겟 정책, Target Policy)이 다를 수 있습니다.

- Q-러닝에서는 타겟 정책은 항상 탐욕적 정책(Greedy Policy)으로, 현재 학습된 Q 값에 대해 가장 높은 Q 값을 주는 행동을 선택합니다.

- 반면, 행동 정책은 탐험(Exploration)을 위해 ε-탐욕적 정책(ε-Greedy Policy) 등을 사용할 수 있습니다. 이를 통해 다양한 상태-행동 쌍을 경험하고 더 나은 Q 값을 학습할 기회를 얻습니다.

4. Q-러닝 업데이트 규칙 (Q-Learning Update Rule)

- Q-러닝은 시간차 학습(Temporal Difference Learning, TD Learning)의 한 형태입니다.

- 현재의 Q 값 추정치와 실제 관찰된 보상 및 다음 상태의 Q 값(TD 타겟) 간의 차이(TD 오차)를 이용하여 Q 값을 업데이트합니다.

- Q(St, At) ← Q(St, At) + α [Rt+1 + γ maxaQ(St+1, a) - Q(St, At)]

- St: 현재 상태

- At: 현재 상태에서 취한 행동

- Rt+1: 행동 At에 대한 보상

- St+1: 행동 At 이후의 다음 상태

- α (Learning Rate, 학습률): 0과 1 사이의 값으로, 새로운 정보를 얼마나 반영할지 결정합니다.

- γ (Discount Factor, 감가율): 미래 보상의 현재 가치를 나타냅니다.

- maxaQ(St+1, a): 다음 상태 St+1에서 가능한 모든 행동 a에 대한 Q 값 중 최댓값. 이것이 오프 폴리시 특성을 나타내는 부분으로, 다음 행동을 실제로 어떤 정책으로 선택했든 상관없이 최적 정책(탐욕 정책)을 가정하고 업데이트합니다.

- [Rt+1 + γ maxaQ(St+1, a)]: TD 타겟. 현재 추정하는 Q(St, At)의 목표값입니다.

- [Rt+1 + γ maxaQ(St+1, a) - Q(St, At)]: TD 오차(TD Error).

5. Q-러닝 알고리즘 (Q-Learning Algorithm)

- 모든 상태-행동 쌍 (s, a)에 대해 Q(s, a)를 임의의 값으로 초기화 (보통 0 또는 작은 무작위 값). 터미널 상태의 Q 값은 0으로 초기화.

- 각 에피소드에 대해 다음을 반복: a. 초기 상태 S를 관찰. b. 에피소드가 끝날 때까지 다음을 반복 (S가 터미널 상태가 아닐 동안): i. 현재 상태 S에서 행동 정책(예: ε-탐욕 정책)에 따라 행동 A를 선택. ii. 행동 A를 수행하고, 보상 R과 다음 상태 S’를 관찰. iii. Q(S, A) ← Q(S, A) + α [R + γ maxa’Q(S’, a’) - Q(S, A)] 를 사용하여 Q 값을 업데이트. iv. S ← S’ (상태를 다음 상태로 업데이트).

6. 수렴 조건

- 학습률 α가 적절히 감소하고, 모든 상태-행동 쌍을 무한히 많이 방문하면 Q(s, a)는 최적 행동 가치 함수 Q*(s, a)로 수렴하는 것이 보장됩니다.

추가 학습 자료

다음 학습 내용

- Day 58: Q-러닝 - 간단한 구현 (Q-Learning - Simple Implementation)

Day 58: Q-러닝 - 간단한 구현 (Q-Learning - Simple Implementation)

학습 목표

- 간단한 환경(예: 그리드 월드)에서 Q-러닝 알고리즘을 파이썬으로 구현

- Q-테이블의 개념과 활용 이해

- ε-탐욕 정책(Epsilon-Greedy Policy) 구현

예제 환경: 간단한 그리드 월드 (Simple Grid World)

- 1xN 또는 MxN 형태의 격자 세계.

- 에이전트는 각 셀(상태)에서 상, 하, 좌, 우 등으로 이동(행동)할 수 있습니다.

- 특정 셀에는 장애물이나 목표 지점이 있을 수 있으며, 이에 따라 보상이 주어집니다.

- 예: 1x5 그리드 월드

[S, F, F, F, G]- S: 시작 지점

- F: 일반 필드 (이동 시 작은 음수 보상 또는 0 보상)

- G: 목표 지점 (도달 시 큰 양수 보상, 에피소드 종료)

- 벽을 벗어나려는 행동은 제자리걸음으로 처리하고 음수 보상을 줄 수 있습니다.

Q-테이블 (Q-Table)

- Q-러닝에서 Q(s, a) 값을 저장하는 테이블 (보통 2차원 배열 또는 딕셔너리).

- 행은 상태(States), 열은 행동(Actions)을 나타냅니다.

Q_table[state][action]은 해당 상태에서 해당 행동을 취했을 때의 Q 값을 의미합니다.- 환경이 단순하고 상태와 행동 공간이 작을 때 유용합니다.

ε-탐욕 정책 (Epsilon-Greedy Policy)

- 탐험(Exploration)과 활용(Exploitation) 사이의 균형을 맞추기 위한 정책.

- 활용: 현재까지 학습된 Q 값 중 가장 높은 값을 주는 행동을 선택 (Greedy action).

- 탐험: 무작위로 행동을 선택하여 새로운 경험을 쌓고, 더 나은 정책을 발견할 가능성을 높임.

- 알고리즘:

- 0과 1 사이의 무작위 수

rand를 생성합니다. rand < ε이면 (확률 ε로):- 가능한 행동 중 하나를 무작위로 선택 (탐험).

- 그렇지 않으면 (

rand ≥ ε이면, 확률 1-ε로):- 현재 상태에서 Q 값이 가장 높은 행동을 선택 (활용).

- 0과 1 사이의 무작위 수

- ε 값은 보통 학습 초반에는 높게 설정하여 탐험을 장려하고, 학습이 진행됨에 따라 점차 낮추어 활용에 집중하도록 합니다 (ε-decay).

파이썬 구현 개요 (슈도코드 스타일)

import numpy as np

# 환경 설정

# 예: 1x5 그리드 월드

# 상태: 0, 1, 2, 3, 4 (S, F, F, F, G)

# 행동: 0 (왼쪽), 1 (오른쪽)

# 보상: 목표 도달 +1, 그 외 0 (간단화)

num_states = 5

num_actions = 2

# Q-테이블 초기화

q_table = np.zeros((num_states, num_actions))

# 하이퍼파라미터

learning_rate = 0.1 # 학습률 (α)

discount_factor = 0.9 # 감가율 (γ)

epsilon = 1.0 # 초기 epsilon 값

max_epsilon = 1.0 # 최대 epsilon 값

min_epsilon = 0.01 # 최소 epsilon 값

epsilon_decay_rate = 0.001 # epsilon 감쇠율

num_episodes = 1000

# 보상 정의 (간단화)

# rewards = { (state, action, next_state): reward_value }

# 또는 함수로 정의: get_reward(state, action, next_state)

# 여기서는 간단하게 목표 상태 도달 시 +1

goal_state = 4

# Q-러닝 알고리즘

for episode in range(num_episodes):

state = 0 # 시작 상태 (S)

done = False

while not done:

# Epsilon-greedy 행동 선택

exploration_exploitation_tradeoff = np.random.uniform(0, 1)

if exploration_exploitation_tradeoff < epsilon:

action = np.random.choice(num_actions) # 탐험: 무작위 행동 선택

else:

action = np.argmax(q_table[state, :]) # 활용: Q값이 가장 높은 행동 선택

# 행동 수행 및 다음 상태, 보상 관찰 (환경과의 상호작용)

# 이 부분은 환경 모델에 따라 달라짐

if action == 0: # 왼쪽

next_state = max(0, state - 1)

else: # 오른쪽

next_state = min(num_states - 1, state + 1)

reward = 0

if next_state == goal_state:

reward = 1

done = True

# Q-테이블 업데이트

q_table[state, action] = q_table[state, action] + learning_rate * \

(reward + discount_factor * np.max(q_table[next_state, :]) - q_table[state, action])

state = next_state

# Epsilon 감쇠

epsilon = min_epsilon + (max_epsilon - min_epsilon) * np.exp(-epsilon_decay_rate * episode)

print("학습된 Q-테이블:")

print(q_table)

# 학습된 정책 테스트

state = 0

path = [state]

while state != goal_state:

action = np.argmax(q_table[state, :])

if action == 0:

state = max(0, state - 1)

else:

state = min(num_states - 1, state + 1)

path.append(state)

if len(path) > 10: # 무한 루프 방지

print("경로를 찾지 못함 또는 너무 김")

break

print("최적 경로 (추정):", path)

고려 사항

- 환경 표현: 실제 구현에서는 환경을 클래스 등으로 더 잘 구조화할 수 있습니다 (예:

step(action)함수를 통해next_state, reward, done, info반환). OpenAI Gym과 유사한 인터페이스를 고려할 수 있습니다. - 보상 설계: 보상을 어떻게 설계하느냐에 따라 에이전트의 학습 결과가 크게 달라집니다.

- 하이퍼파라미터 튜닝:

learning_rate,discount_factor,epsilon관련 값들은 문제와 환경에 따라 적절히 조절해야 합니다. - 수렴: 간단한 문제에서는 Q-테이블이 최적 값으로 빠르게 수렴할 수 있지만, 복잡한 문제에서는 많은 에피소드가 필요할 수 있습니다.

추가 학습 자료

- Q-Learning Example with Python (Towards Data Science)

- OpenAI Gym FrozenLake Q-Learning (YouTube) (Gym 환경에서의 예시)

다음 학습 내용

- Day 59: 심층 Q-네트워크 (DQN) - 개념 및 장점 (Deep Q-Networks (DQN) - Concept and Advantages)

Day 59: 심층 Q-네트워크 (DQN) - 개념 및 장점 (Deep Q-Networks (DQN) - Concept and Advantages)

학습 목표

- 전통적인 Q-러닝의 한계점 이해

- 심층 Q-네트워크(DQN)의 기본 아이디어와 구성 요소 학습

- DQN이 Q-테이블 대신 신경망을 사용하는 이유와 장점 이해

- DQN의 주요 기법(경험 재현, 타겟 네트워크) 소개

전통적인 Q-러닝의 한계점

-

상태 공간의 저주 (Curse of Dimensionality):

- Q-테이블은 상태와 행동의 모든 가능한 조합에 대한 Q 값을 저장해야 합니다.

- 상태 공간이나 행동 공간이 매우 커지면 (예: 연속적인 상태 공간, 고차원 이미지 입력), Q-테이블을 유지하고 업데이트하는 데 필요한 메모리와 계산량이 기하급수적으로 증가하여 현실적으로 불가능해집니다.

- 예: 아타리 게임의 경우, 화면 픽셀 하나하나를 상태로 간주하면 상태 공간이 엄청나게 커집니다.

-

일반화 능력 부족:

- Q-테이블은 각 상태-행동 쌍에 대한 Q 값을 개별적으로 학습합니다.

- 따라서, 비슷한 상태들에 대한 정보를 일반화하여 활용하기 어렵습니다. 방문해보지 않은 상태에 대해서는 Q 값을 추정할 수 없습니다.

심층 Q-네트워크 (Deep Q-Network, DQN)

- 2013년 DeepMind에서 제안하고, 2015년 Nature에 발표된 알고리즘으로, 심층 신경망(Deep Neural Network)을 사용하여 Q-함수를 근사(approximate)합니다.

- Q-테이블 대신 신경망

Q(s, a; θ)를 사용하여, 상태s를 입력으로 받아 각 행동a에 대한 Q 값을 출력하거나, 상태s와 행동a를 입력으로 받아 해당 Q 값을 출력합니다. (일반적으로 전자를 많이 사용)θ는 신경망의 가중치(weights)를 나타냅니다.

- 이를 통해 Q-러닝을 고차원의 상태 공간(예: 이미지 입력)을 가진 문제에 적용할 수 있게 되었습니다.

DQN의 기본 아이디어

- 신경망을 사용하여 Q-함수를 근사:

Q(s, a; θ) ≈ Q*(s, a) - 손실 함수(Loss Function)를 정의하고, 경사 하강법(Gradient Descent)을 사용하여 신경망의 가중치

θ를 업데이트합니다. - 손실 함수는 Q-러닝의 업데이트 규칙에서 TD 오차와 유사하게 정의됩니다:

L(θ) = E(s,a,r,s’)~D [ ( r + γ maxa’Q(s’, a’; θ-) - Q(s, a; θ) )2 ]

θ: 현재 Q-네트워크의 가중치θ<sup>-</sup>: 타겟 Q-네트워크의 가중치 (아래 설명 참조)D: 경험 재현 메모리 (아래 설명 참조)r + γ max<sub>a'</sub>Q(s', a'; θ<sup>-</sup>): TD 타겟 (목표값)Q(s, a; θ): 현재 Q-네트워크의 예측값

DQN의 장점

- 고차원 입력 처리: 이미지를 직접 입력으로 받아 처리하는 등 복잡하고 큰 상태 공간을 다룰 수 있습니다. (예: Convolutional Neural Networks, CNN 사용)

- 일반화 성능: 신경망은 학습된 데이터로부터 패턴을 학습하여, 이전에 방문하지 않은 유사한 상태에 대해서도 Q 값을 추정할 수 있는 일반화 능력을 가집니다.

- 메모리 효율성: 거대한 Q-테이블을 저장하는 대신, 상대적으로 작은 크기의 신경망 가중치만 저장하면 됩니다.

DQN의 주요 기법

1. 경험 재현 (Experience Replay)

- 에이전트가 환경과 상호작용하며 얻는 경험 샘플

(s_t, a_t, r_{t+1}, s_{t+1})을 리플레이 메모리(Replay Memory)D에 저장합니다. - 신경망 학습 시, 리플레이 메모리에서 미니배치(mini-batch)를 무작위로 샘플링하여 사용합니다.

- 장점:

- 데이터 효율성 향상: 하나의 경험 샘플이 여러 번의 학습에 사용될 수 있습니다.

- 샘플 간의 상관관계 감소: 순차적으로 들어오는 데이터는 시간적 상관관계가 높아 학습을 불안정하게 만들 수 있습니다. 무작위 샘플링은 이러한 상관관계를 줄여 학습 안정성을 높입니다.

- 학습 안정성: 특정 패턴의 데이터가 연속적으로 들어오는 것을 방지하여 학습이 특정 방향으로 치우치는 것을 막아줍니다.

2. 타겟 네트워크 분리 (Separate Target Network)

- Q-러닝 업데이트 시 TD 타겟

y_i = r + γ max<sub>a'</sub>Q(s', a'; θ)을 계산할 때, 현재 Q-값을 예측하는 네트워크와 동일한 네트워크를 사용하면 학습이 불안정해질 수 있습니다.- Q-값을 업데이트하면 TD 타겟도 함께 변하게 되어, 학습 목표가 계속 흔들리는 문제가 발생합니다 (Moving Target Problem).

- 해결책: 두 개의 신경망을 사용합니다.

- 메인 네트워크 (Main Network, Q-Network):

Q(s, a; θ). 주로 학습(가중치 업데이트)이 이루어지는 네트워크. - 타겟 네트워크 (Target Network):

Q(s', a'; θ<sup>-</sup>). TD 타겟을 계산하는 데 사용되는 네트워크.- 타겟 네트워크의 가중치

θ<sup>-</sup>는 주기적으로 메인 네트워크의 가중치θ로 복사되어 업데이트됩니다 (예: 매 C 스텝마다). - 타겟 네트워크는 학습 과정에서 고정되어 있어 TD 타겟값을 안정적으로 유지시켜 학습 안정성을 높입니다.

- 타겟 네트워크의 가중치

- 메인 네트워크 (Main Network, Q-Network):

DQN 알고리즘 개요

- 리플레이 메모리 D를 특정 크기로 초기화.

- 행동-가치 함수 Q를 무작위 가중치 θ로 초기화 (메인 네트워크).

- 타겟 행동-가치 함수 Q̂를 가중치 θ- = θ로 초기화 (타겟 네트워크).

- 각 에피소드에 대해: a. 초기 상태 s1을 관찰. b. 에피소드가 끝날 때까지 (t=1 부터 T까지): i. ε-탐욕 정책에 따라 행동 at를 선택 (Q(st, · ; θ) 사용). ii. 행동 at를 수행하고, 보상 rt+1과 다음 상태 st+1을 관찰. iii. 경험 (st, at, rt+1, st+1)을 D에 저장. iv. D에서 미니배치 (sj, aj, rj+1, sj+1)를 무작위로 샘플링. v. 타겟 yj 설정: - 만약 sj+1이 터미널 상태이면, yj = rj+1. - 그렇지 않으면, yj = rj+1 + γ maxa’Q̂(sj+1, a’; θ-). vi. 손실 (yj - Q(sj, aj; θ))2 에 대해 경사 하강법을 수행하여 메인 네트워크 가중치 θ 업데이트. vii. 매 C 스텝마다 타겟 네트워크 가중치 업데이트: θ- ← θ.

추가 학습 자료

- DeepMind Nature Paper (2015) - Human-level control through deep reinforcement learning

- Playing Atari with Deep Reinforcement Learning (NIPS 2013 Workshop Paper)

- [DQN Explained - Let’s Code DQN (YouTube by SimpleAI)](https://www.youtube.com/watch?v= নারদ7377&list=PLZbbT5o_s2xobby-M9D9sRehVjjYmS3ob&index=2)

다음 학습 내용

- Day 60: 자연어 처리 소개 (Introduction to Natural Language Processing)

Day 60: 자연어 처리 소개 (Introduction to Natural Language Processing, NLP)

학습 목표

- 자연어 처리(NLP)의 정의와 중요성 이해

- NLP의 주요 응용 분야 파악

- NLP의 주요 과제 및 어려움 인식

- NLP의 기본 용어(코퍼스, 토큰, 형태소, 어휘, 문법 등) 학습

핵심 개념

1. 자연어 처리 (Natural Language Processing, NLP)

- 인간이 사용하는 언어(자연어)를 컴퓨터가 이해하고, 해석하고, 생성할 수 있도록 하는 인공지능(AI) 및 언어학의 한 분야입니다.

- 목표는 컴퓨터와 인간 사이의 자연스러운 의사소통을 가능하게 하고, 대량의 텍스트 데이터로부터 의미 있는 정보를 추출하는 것입니다.

2. NLP의 중요성

- 정보 과잉 시대: 웹, 소셜 미디어, 문서 등 방대한 양의 텍스트 데이터가 생성되고 있으며, NLP는 이로부터 가치 있는 정보를 추출하고 활용하는 데 필수적입니다.

- 인간-컴퓨터 상호작용 개선: 음성 비서, 챗봇 등과 같이 보다 자연스럽고 직관적인 방식으로 컴퓨터와 상호작용할 수 있게 합니다.

- 다양한 산업 응용: 검색 엔진, 번역, 고객 서비스, 의료, 금융, 법률 등 다양한 분야에서 활용됩니다.

3. NLP의 주요 응용 분야

- 기계 번역 (Machine Translation): 한 언어로 된 텍스트를 다른 언어로 자동 번역 (예: Google Translate, Papago).

- 정보 검색 (Information Retrieval): 대규모 문서 집합에서 사용자가 원하는 정보를 포함하는 문서를 찾는 기술 (예: 검색 엔진).

- 텍스트 분류 (Text Classification): 텍스트를 미리 정의된 카테고리로 분류 (예: 스팸 메일 필터링, 뉴스 기사 주제 분류, 감성 분석).

- 감성 분석 (Sentiment Analysis): 텍스트에 나타난 주관적인 의견, 감정, 태도 등을 분석 (예: 영화 리뷰 긍/부정 판단).

- 질의응답 시스템 (Question Answering, QA): 사용자의 질문에 대해 자연어로 답변하는 시스템 (예: 챗봇, AI 스피커).

- 텍스트 요약 (Text Summarization): 긴 문서의 핵심 내용을 간결하게 요약.

- 개체명 인식 (Named Entity Recognition, NER): 텍스트에서 인명, 지명, 기관명 등 고유한 의미를 갖는 개체명을 인식하고 분류.

- 음성 인식 (Speech Recognition): 사람의 음성을 텍스트로 변환.

- 텍스트 생성 (Text Generation): 특정 주제나 스타일에 맞춰 새로운 텍스트를 생성 (예: 기사 작성, 소설 창작).

4. NLP의 주요 과제 및 어려움

- 모호성 (Ambiguity):

- 어휘적 모호성: 하나의 단어가 여러 의미를 가짐 (예: “배” - 과일, 선박, 신체 부위).

- 구문적 모호성: 문장의 구조가 여러 가지로 해석될 수 있음 (예: “나는 예쁜 그녀의 친구를 보았다” - ’예쁜’이 ’그녀’를 수식하는지 ’친구’를 수식하는지).

- 의미적 모호성: 문맥에 따라 의미가 달라짐.

- 동의어 및 다의어 처리: 의미가 같거나 유사한 단어들, 여러 의미를 가진 단어들을 처리하는 문제.

- 신조어 및 비표준어: 끊임없이 생성되는 신조어나 오타, 비문법적인 표현 등을 처리하는 어려움.

- 문맥 의존성: 단어나 문장의 의미가 주변 문맥에 크게 의존.

- 세계 지식 및 상식의 부족: 컴퓨터는 인간처럼 세상에 대한 배경지식이나 상식을 가지고 있지 않음.

- 언어별 특성: 언어마다 문법 구조, 어순, 표현 방식 등이 매우 다름.

5. NLP 기본 용어

- 말뭉치 (Corpus, 복수형 Corpora): 특정 목적을 위해 수집된 대량의 텍스트 또는 음성 데이터 집합. NLP 모델 학습 및 평가에 사용됩니다.

- 토큰 (Token): 분석을 위해 텍스트를 더 작은 단위로 나눈 것. 일반적으로 단어, 문장 부호 등이 토큰이 될 수 있습니다.

- 토큰화 (Tokenization): 텍스트를 토큰 단위로 분리하는 과정.

- 형태소 (Morpheme): 의미를 가지는 가장 작은 언어 단위. (예: ‘읽다’ -> ‘읽-’ (어간), ‘-다’ (어미))

- 형태소 분석 (Morphological Analysis): 단어를 형태소 단위로 분해하고 각 형태소의 품사 정보를 부착하는 과정. 한국어 NLP에서 특히 중요합니다.

- 어휘 (Vocabulary / Lexicon): 특정 언어 또는 말뭉치에서 사용되는 모든 단어(또는 토큰)의 집합.

- 문법 (Grammar): 단어들이 결합하여 문장을 이루는 규칙.

- 구문 분석 (Parsing / Syntactic Analysis): 문장의 구조를 분석하여 문법적인 관계를 파악하는 과정. (예: 주어, 동사, 목적어 등)

- 의미 분석 (Semantic Analysis): 단어, 구, 문장의 의미를 이해하고 해석하는 과정.

추가 학습 자료

다음 학습 내용

- Day 61: 텍스트 전처리 - 토큰화, 어간 추출, 표제어 추출 (Text Preprocessing - Tokenization, Stemming, Lemmatization)

Day 61: 텍스트 전처리 (Text Preprocessing)

학습 목표

- 텍스트 전처리의 중요성과 목적 이해

- 주요 텍스트 전처리 기법 학습:

- 문장 분리 (Sentence Segmentation)

- 토큰화 (Tokenization)

- 정제 (Cleaning) 및 정규화 (Normalization)

- 불용어 제거 (Stopword Removal)

- 어간 추출 (Stemming)

- 표제어 추출 (Lemmatization)

1. 텍스트 전처리란?

- 자연어 텍스트를 분석 가능한 형태로 가공하고 정제하는 일련의 과정입니다.

- 목적:

- 분석의 정확도 향상

- 계산 효율성 증대

- 데이터의 일관성 유지

- 노이즈 제거

2. 주요 텍스트 전처리 기법

가. 문장 분리 (Sentence Segmentation / Sentence Tokenization)

- 텍스트를 개별 문장 단위로 분리하는 작업입니다.

- 문장 부호(마침표(.), 물음표(?), 느낌표(!)) 등을 기준으로 분리하지만, 예외 케이스(Dr., Mr., Ph.D. 등)를 고려해야 합니다.

- 파이썬 라이브러리:

NLTK의sent_tokenize

나. 토큰화 (Tokenization / Word Tokenization)

- 문장을 의미 있는 최소 단위인 토큰(주로 단어)으로 분리하는 작업입니다.

- 공백, 문장 부호 등을 기준으로 분리할 수 있습니다.

- 어절 단위 토큰화, 단어 단위 토큰화, 형태소 단위 토큰화 등 다양한 수준이 있습니다.

- 파이썬 라이브러리:

NLTK의word_tokenize,spaCy, 한국어의 경우KoNLPy(Okt, Mecab 등)

다. 정제 (Cleaning) 및 정규화 (Normalization)

- 텍스트에서 불필요하거나 분석에 방해가 되는 요소를 제거하고, 표현을 통일하는 과정입니다.

- 정제 (Cleaning):

- HTML 태그 제거 (예: 웹 크롤링 데이터)

- 특수 문자, 숫자, 이모티콘 등 제거 또는 대체

- 오타 수정

- 정규화 (Normalization):

- 대소문자 통일 (주로 소문자로 변환)

- 축약형 풀기 (예: “don’t” -> “do not”)

- 철자 변이 통일 (예: “color”, “colour” -> “color”)

- 숫자 표현 통일 (예: “1,000”, “one thousand” -> “1000”)

라. 불용어 제거 (Stopword Removal)

- 분석에 큰 의미가 없으면서 자주 등장하는 단어(불용어)를 제거하는 작업입니다.

- 예: “a”, “an”, “the”, “is”, “are”, “of”, “on”, “in” (영어) / “은”, “는”, “이”, “가”, “을”, “를” (한국어)

- 불용어 목록은 직접 정의하거나 라이브러리에서 제공하는 것을 사용할 수 있습니다.

- 파이썬 라이브러리:

NLTK의stopwords

마. 어간 추출 (Stemming)

- 단어의 어미(접미사)를 제거하여 어간(stem)만을 추출하는 과정입니다.

- 목적: 단어의 다양한 활용형을 동일한 형태로 통일하여 단어의 수를 줄이고 분석의 일관성을 높입니다.

- 규칙 기반으로 작동하며, 때로는 문법적으로 정확하지 않은 어간을 추출할 수 있습니다 (예: “running” -> “runn”, “flies” -> “fli”).

- 속도가 빠르다는 장점이 있습니다.

- 대표적인 알고리즘: 포터 스테머(Porter Stemmer), 랭커스터 스테머(Lancaster Stemmer)

- 파이썬 라이브러리:

NLTK의PorterStemmer,LancasterStemmer

바. 표제어 추출 (Lemmatization)

- 단어의 기본형, 즉 표제어(lemma)를 추출하는 과정입니다.

- 품사 정보와 문맥을 고려하여 단어의 사전적 기본형을 찾습니다. (예: “running” -> “run”, “flies” -> “fly”, “better” -> “good”)

- 어간 추출보다 문법적으로 정확한 결과를 제공하지만, 더 복잡하고 시간이 오래 걸릴 수 있습니다.

- 일반적으로 어간 추출보다 선호되나, 분석 목적과 성능 요구사항에 따라 선택합니다.

- 파이썬 라이브러리:

NLTK의WordNetLemmatizer,spaCy

3. 한국어 텍스트 전처리 특수성

- 형태소 분석의 중요성: 한국어는 교착어로, 어근에 접사가 붙어 단어의 의미와 문법적 기능이 결정됩니다. 따라서 단순 공백 토큰화보다는 형태소 분석기를 사용하여 명사, 동사, 형용사 등을 추출하는 것이 효과적입니다. (KoNLPy 라이브러리 활용)

- 띄어쓰기 오류: 한국어는 띄어쓰기가 틀려도 의미 전달이 되는 경우가 많아, 띄어쓰기 교정 작업이 필요할 수 있습니다.

- 다양한 어미 활용: 동사나 형용사의 활용형이 매우 다양하여 어간 추출이나 표제어 추출의 중요성이 큽니다.

4. 전처리 파이프라인 예시

- 텍스트 로드

- (선택적) 소문자화

- 문장 분리

- 각 문장에 대해: a. 토큰화 (단어 또는 형태소) b. (선택적) 정제 (특수문자 제거 등) c. (선택적) 불용어 제거 d. 어간 추출 또는 표제어 추출

- 전처리된 토큰 리스트 생성

추가 학습 자료

다음 학습 내용

- Day 62: Bag-of-Words 및 TF-IDF (Bag-of-Words and TF-IDF)

Day 62: Bag-of-Words 및 TF-IDF

학습 목표

- 텍스트 데이터를 수치 벡터로 변환하는 기법 학습

- Bag-of-Words (BoW) 모델의 개념과 구현 방법 이해

- TF-IDF (Term Frequency-Inverse Document Frequency)의 개념과 계산 방법, 중요성 이해

1. 텍스트 표현 (Text Representation)의 필요성

- 머신러닝 알고리즘은 대부분 숫자 입력을 가정합니다.

- 따라서, 텍스트 데이터를 분석하고 모델링하기 위해서는 텍스트를 수치적인 형태로 변환하는 과정이 필요합니다. 이를 텍스트 표현 또는 특징 벡터화(Feature Vectorization)라고 합니다.

2. Bag-of-Words (BoW)

가. 개념

- 가장 간단하면서도 널리 사용되는 텍스트 표현 방법 중 하나입니다.

- 문서를 단어들의 “가방“으로 간주합니다. 즉, 단어의 순서나 문맥은 무시하고, 문서 내 각 단어의 출현 빈도수(Term Frequency)에만 집중합니다.

- 각 문서는 고유한 단어들의 집합(어휘, Vocabulary)을 기준으로, 해당 단어가 문서에 몇 번 등장했는지를 나타내는 벡터로 표현됩니다.

나. BoW 구축 과정

- 토큰화 (Tokenization): 각 문서를 단어(토큰) 단위로 분리합니다.

- 어휘 구축 (Vocabulary Building): 전체 문서 집합(Corpus)에 등장하는 모든 고유한 단어들의 집합을 만듭니다. 이 어휘집이 벡터의 차원이 됩니다.

- 벡터화 (Vectorization): 각 문서를 어휘집의 단어 순서대로 정렬된 벡터로 표현합니다. 벡터의 각 요소는 해당 단어가 해당 문서에 등장한 횟수(빈도수)를 나타냅니다.

다. 예시

- 문서 1: “John likes to watch movies. Mary likes movies too.”

- 문서 2: “John also likes to watch football games.”

-

토큰화 및 정제 (소문자화, 구두점 제거 등 가정)

- 문서 1 토큰:

["john", "likes", "to", "watch", "movies", "mary", "likes", "movies", "too"] - 문서 2 토큰:

["john", "also", "likes", "to", "watch", "football", "games"]

- 문서 1 토큰:

-

어휘 구축

- 전체 어휘:

{"john", "likes", "to", "watch", "movies", "mary", "too", "also", "football", "games"} - (정렬된 어휘) ->

["also", "football", "games", "john", "likes", "mary", "movies", "to", "too", "watch"](10차원 벡터)

- 전체 어휘:

-

벡터화 (단어 빈도수 기준)

- 문서 1 벡터:

[0, 0, 0, 1, 2, 1, 2, 1, 1, 1]- (also:0, football:0, games:0, john:1, likes:2, mary:1, movies:2, to:1, too:1, watch:1)

- 문서 2 벡터:

[1, 1, 1, 1, 1, 0, 0, 1, 0, 1]- (also:1, football:1, games:1, john:1, likes:1, mary:0, movies:0, to:1, too:0, watch:1)

- 문서 1 벡터:

라. 장점

- 구현이 간단하고 이해하기 쉽습니다.

- 텍스트 분류, 정보 검색 등 다양한 NLP 작업에서 기본적으로 사용될 수 있습니다.

마. 단점

- 단어 순서 무시: 문맥 정보를 잃어버려 의미 파악에 한계가 있습니다. (예: “I hate you” vs “You hate I“는 동일한 BoW 벡터를 가질 수 있음)

- 희소성 문제 (Sparsity): 어휘집의 크기가 매우 커지면 대부분의 값이 0인 희소 벡터(Sparse Vector)가 생성되어 계산 비효율성 및 성능 저하를 유발할 수 있습니다.

- 불용어 문제: “the”, “a“와 같이 자주 등장하지만 의미는 적은 단어들이 높은 빈도수를 가질 수 있습니다. (TF-IDF로 일부 보완 가능)

- 단어의 의미적 유사성 반영 불가: “car“와 “automobile“은 다른 단어로 취급됩니다.

바. 파이썬 구현

scikit-learn의CountVectorizer사용

from sklearn.feature_extraction.text import CountVectorizer

corpus = [

'John likes to watch movies. Mary likes movies too.',

'John also likes to watch football games.'

]

vectorizer = CountVectorizer()

X = vectorizer.fit_transform(corpus)

print(vectorizer.get_feature_names_out())

# ['also', 'football', 'games', 'john', 'likes', 'mary', 'movies', 'to', 'too', 'watch']

print(X.toarray())

# [[0 1 1 1 2 1 2 1 1] <- 오타 수정: 실제 출력은 위 예시와 같아야 함

# [1 1 1 1 1 0 0 1 0 1]]

3. TF-IDF (Term Frequency - Inverse Document Frequency)

가. 개념

- BoW의 단점을 보완하기 위해 등장한 가중치 부여 방식입니다.

- 단순히 단어의 빈도수만 고려하는 것이 아니라, 특정 단어가 한 문서에 얼마나 자주 등장하는지(TF)와 함께, 그 단어가 전체 문서 집합에서 얼마나 희귀한지(IDF)를 고려하여 단어의 중요도를 계산합니다.

- 즉, 한 문서 내에서는 자주 등장하지만 다른 여러 문서에서는 잘 등장하지 않는 단어일수록 중요도가 높다고 판단합니다.

나. TF (Term Frequency, 단어 빈도)

- 특정 단어가 특정 문서 내에 얼마나 자주 등장하는지를 나타내는 값입니다.

- 계산 방법은 다양하지만, 가장 기본적인 방법은 해당 단어의 등장 횟수입니다.

TF(t, d)= (문서 d에서 단어 t의 등장 횟수) / (문서 d의 전체 단어 수) (정규화된 TF)- 또는 단순히

TF(t, d)= (문서 d에서 단어 t의 등장 횟수)

다. IDF (Inverse Document Frequency, 역문서 빈도)

- 특정 단어가 전체 문서 집합에서 얼마나 드물게 등장하는지를 나타내는 값입니다.

- 이 값이 클수록 해당 단어는 특정 문서의 주제를 잘 나타내는 희귀한 단어일 가능성이 높습니다.

IDF(t, D)= log ( (전체 문서 수) / (단어 t를 포함하는 문서 수 + 1) )- 분모에 1을 더하는 것은 특정 단어가 모든 문서에 등장하지 않아 0으로 나누어지는 것을 방지하기 위함입니다 (Smoothing).

- 로그를 취하는 이유는 문서 수의 차이가 극심할 때 값의 스케일을 줄여주기 위함입니다.

라. TF-IDF 계산

TF-IDF(t, d, D) = TF(t, d) * IDF(t, D)- TF-IDF 값은 특정 문서 d 내에서 특정 단어 t의 중요도를 나타냅니다.

- 이 값을 사용하여 BoW 벡터를 구성하면, 단순히 빈도수만 사용했을 때보다 단어의 중요도를 더 잘 반영하는 텍스트 표현을 얻을 수 있습니다.

마. 장점

- BoW에 비해 단어의 중요도를 더 잘 반영할 수 있습니다.

- 모든 문서에 자주 등장하는 불용어의 영향력을 줄일 수 있습니다 (IDF 값이 낮아짐).

바. 단점

- 여전히 단어의 순서나 문맥 정보를 반영하지 못합니다.

- 단어의 의미적 유사성은 고려하지 못합니다.

사. 파이썬 구현

scikit-learn의TfidfVectorizer사용

from sklearn.feature_extraction.text import TfidfVectorizer

corpus = [

'John likes to watch movies. Mary likes movies too.',

'John also likes to watch football games.'

]

tfidf_vectorizer = TfidfVectorizer()

X_tfidf = tfidf_vectorizer.fit_transform(corpus)

print(tfidf_vectorizer.get_feature_names_out())

print(X_tfidf.toarray())

추가 학습 자료

다음 학습 내용

- Day 63: 단어 임베딩 - Word2Vec, GloVe (개념) (Word Embeddings - Word2Vec, GloVe (Conceptual))

Day 63: 단어 임베딩 - Word2Vec, GloVe (개념) (Word Embeddings - Word2Vec, GloVe (Conceptual))

학습 목표

- 기존 텍스트 표현 방식(BoW, TF-IDF)의 한계점 재확인

- 단어 임베딩(Word Embedding)의 개념과 필요성 이해

- 분산 표현(Distributed Representation)의 의미 학습

- 대표적인 단어 임베딩 모델인 Word2Vec과 GloVe의 기본 아이디어 및 특징 비교

1. 기존 텍스트 표현 방식의 한계

- BoW, TF-IDF:

- 희소 표현 (Sparse Representation): 어휘집 크기가 커지면 벡터가 매우 희소해지고 차원이 커집니다.

- 단어 의미 반영 부족: 단어 간의 의미적 유사성이나 관계를 파악하기 어렵습니다. (예: “강아지“와 “개“는 서로 다른 단어로 취급)

- 문맥 정보 손실: 단어의 순서나 주변 단어와의 관계를 고려하지 않습니다.

2. 단어 임베딩 (Word Embedding)이란?

- 단어를 고정된 크기의 **저차원 실수 벡터(Dense Vector)**로 표현하는 기법입니다.

- 각 단어는 벡터 공간의 한 점으로 매핑되며, 이 벡터를 **임베딩 벡터(Embedding Vector)**라고 합니다.

- 핵심 아이디어: “비슷한 의미를 가진 단어는 벡터 공간에서 서로 가까이 위치한다.”

- 단어의 의미를 벡터에 함축적으로 담아내려고 시도합니다.

분산 표현 (Distributed Representation)

- 단어 임베딩은 단어의 의미를 여러 차원에 분산하여 표현합니다.

- 벡터의 각 차원이 특정 의미적 또는 문법적 특징을 나타내는 것은 아니지만, 전체적으로 단어의 의미를 포착합니다.

- 예: “king” - “man” + “woman” ≈ “queen” 과 같은 단어 간의 의미론적 관계를 벡터 연산으로 표현 가능.

단어 임베딩의 장점

- 차원 축소: 고차원의 희소 벡터 대신 저차원의 밀집 벡터를 사용하므로 계산 효율성이 높습니다.

- 의미적 유사도 반영: 의미가 유사한 단어들은 벡터 공간에서 가까운 거리에 위치하게 되어 단어 간 관계를 파악할 수 있습니다.

- 일반화 성능 향상: 모델이 학습 데이터에 없는 단어와 유사한 의미의 단어를 처리하는 데 도움을 줄 수 있습니다.

- 다양한 NLP 작업 성능 향상: 텍스트 분류, 기계 번역, 감성 분석 등에서 성능 향상을 가져옵니다.

3. Word2Vec (Word to Vector)

가. 기본 아이디어

- 2013년 Google의 Mikolov 등이 제안한 신경망 기반의 단어 임베딩 모델입니다.

- “주변 단어가 비슷하면 해당 단어의 의미도 비슷할 것이다” 라는 분포 가설(Distributional Hypothesis)에 기반합니다.

- 특정 단어 주변에 나타나는 단어들을 예측하거나, 주변 단어들로부터 특정 단어를 예측하는 과정에서 단어의 임베딩 벡터를 학습합니다.

나. 주요 모델 구조

-

CBOW (Continuous Bag-of-Words):

- 주변 단어들(Context Words)이 주어졌을 때, 중심 단어(Center Word)를 예측하는 모델입니다.

- 여러 주변 단어의 임베딩 벡터를 사용하여 중심 단어의 임베딩 벡터를 예측합니다.

- 작은 데이터셋에서 성능이 좋고 학습 속도가 빠릅니다.

(이미지 출처: Wikidocs)

-

Skip-gram:

- 중심 단어(Center Word)가 주어졌을 때, 주변 단어들(Context Words)을 예측하는 모델입니다.

- 하나의 중심 단어 임베딩 벡터를 사용하여 여러 주변 단어의 임베딩 벡터를 예측합니다.

- 일반적으로 CBOW보다 성능이 우수하며, 특히 등장 빈도가 낮은 단어에 대해 더 잘 학습합니다.

- 학습 시간이 CBOW보다 오래 걸립니다.

(이미지 출처: Wikidocs)

다. 학습 방식 (간략히)

- 입력층, 은닉층(투사층, Projection Layer), 출력층으로 구성된 얕은 신경망(Shallow Neural Network)을 사용합니다.

- 은닉층의 가중치가 바로 단어의 임베딩 벡터가 됩니다.

- 실제로는 계산 효율성을 위해 Negative Sampling이나 Hierarchical Softmax와 같은 최적화 기법을 사용합니다.

4. GloVe (Global Vectors for Word Representation)

가. 기본 아이디어

- 2014년 Stanford 대학에서 제안한 단어 임베딩 모델입니다.

- Word2Vec과 달리, 전체 말뭉치(Corpus)의 단어 동시 등장 빈도 행렬(Word Co-occurrence Matrix) 정보를 직접 사용하여 단어 임베딩을 학습합니다.

- “단어 간의 동시 등장 빈도 비율이 의미적 관계를 나타낸다“는 직관에 기반합니다.

- 예: “ice“는 “solid“와 자주 함께 등장하지만 “gas“와는 덜 등장하고, “steam“은 “gas“와 자주 함께 등장하지만 “solid“와는 덜 등장합니다. 이러한 비율 관계를 학습합니다.

나. 학습 방식 (간략히)

-

단어 동시 등장 빈도 행렬 구축:

- 전체 말뭉치에서 특정 윈도우 크기 내에 두 단어가 함께 등장한 횟수를 계산하여 행렬을 만듭니다.

- Xij: 단어 i의 문맥에 단어 j가 등장한 횟수.

-

손실 함수 설계:

- 임베딩된 단어 벡터 간의 내적(Dot Product)이 두 단어의 동시 등장 빈도 로그값과 유사해지도록 학습합니다.

- wiTw̃j + bi + b̃j ≈ log(Xij)

- wi: 중심 단어 i의 임베딩 벡터

- w̃j: 주변 단어 j의 임베딩 벡터 (별도의 임베딩 행렬 사용)

- bi, b̃j: 각 단어의 편향(bias) 항

- 가중치 함수 f(Xij)를 사용하여 등장 빈도가 낮은 단어에 과도하게 가중치가 부여되거나, 매우 높은 단어에 과도하게 가중치가 부여되는 것을 방지합니다.

다. 특징

- 전역적 통계 정보 활용: 말뭉치 전체의 통계 정보를 직접적으로 활용하여 학습합니다.

- 학습 속도: Word2Vec보다 학습 속도가 빠를 수 있습니다.

- 성능: 종종 Word2Vec과 유사하거나 더 나은 성능을 보이며, 특히 작은 데이터셋에서 강점을 가질 수 있습니다.

5. Word2Vec vs GloVe

| 특징 | Word2Vec (Skip-gram) | GloVe |

|---|---|---|

| 기본 아이디어 | 지역적 문맥 정보 (Local context window) | 전역적 동시 등장 통계 (Global co-occurrence counts) |

| 학습 방식 | 주변 단어 예측 (Predictive) | 동시 등장 행렬 분해 (Count-based / Matrix Factorization) |

| 장점 | 다양한 크기의 데이터셋에서 잘 작동, 의미론적 관계 포착 우수 | 학습 속도가 빠를 수 있음, 전역적 통계 정보 명시적 활용 |

| 단점 | 말뭉치 전체 통계 정보를 간접적으로만 활용, 학습 시간 소요 | 큰 메모리 필요 (동시 등장 행렬), 하이퍼파라미터 튜닝 민감 가능 |

- 실제로는 두 모델 모두 좋은 성능을 보이며, 문제나 데이터셋의 특성에 따라 선택적으로 사용되거나, 사전 훈련된 임베딩(Pre-trained Embeddings)을 활용하는 경우가 많습니다.

추가 학습 자료

- Word2Vec Tutorial - The Skip-Gram Model (Chris McCormick)

- GloVe: Global Vectors for Word Representation (Project Page)

- 딥 러닝을 이용한 자연어 처리 입문 - Word2Vec, GloVe

다음 학습 내용

- Day 64: Word2Vec 구현 (Implementing Word2Vec (e.g., using Gensim))

Day 64: Word2Vec 구현 (Implementing Word2Vec (e.g., using Gensim))

학습 목표

- 파이썬 라이브러리

Gensim을 사용하여 Word2Vec 모델을 학습시키는 방법 이해 - Word2Vec 모델의 주요 하이퍼파라미터 설정 및 의미 파악

- 학습된 임베딩 벡터를 확인하고 단어 간 유사도를 측정하는 방법 학습

1. Gensim 라이브러리 소개

Gensim은 토픽 모델링(Topic Modeling)과 자연어 처리(NLP)를 위한 강력하고 효율적인 파이썬 라이브러리입니다.- Word2Vec, FastText, Doc2Vec 등 다양한 단어 및 문서 임베딩 알고리즘을 쉽게 구현하고 사용할 수 있도록 지원합니다.

- 대용량 텍스트 데이터 처리에 최적화되어 있습니다.

Gensim 설치

pip install gensim

필요에 따라 nltk (토큰화 등 전처리)도 함께 설치합니다.

pip install nltk

2. Word2Vec 학습 과정 (Gensim 사용)

가. 데이터 준비 및 전처리

- Word2Vec 모델을 학습시키기 위해서는 토큰화된 문장들의 리스트가 필요합니다.

- 각 문장은 단어(토큰)들의 리스트 형태여야 합니다.

- 예:

sentences = [['this', 'is', 'the', 'first', 'sentence'], ['this', 'is', 'the', 'second', 'sentence']]

import nltk

from nltk.tokenize import sent_tokenize, word_tokenize

# nltk.download('punkt') # 처음 실행 시 필요할 수 있음

# 예제 텍스트 데이터 (실제로는 더 큰 코퍼스를 사용)

corpus_text = """

Natural language processing (NLP) is a subfield of linguistics, computer science, and artificial intelligence.

It is concerned with the interactions between computers and human language.

In particular, how to program computers to process and analyze large amounts of natural language data.

Challenges in natural language processing frequently involve speech recognition, natural language understanding, and natural language generation.

"""

# 1. 문장 분리

raw_sentences = sent_tokenize(corpus_text)

# print(raw_sentences)

# 2. 각 문장을 단어 리스트로 토큰화 및 소문자화 (간단한 전처리)

sentences = []

for raw_sentence in raw_sentences:

tokens = [word.lower() for word in word_tokenize(raw_sentence) if word.isalpha()] # 알파벳만 남기고 소문자화

if tokens: # 빈 리스트가 아닐 경우에만 추가

sentences.append(tokens)

print("전처리된 문장 리스트:")

for s in sentences:

print(s)

# 출력 예시:

# ['natural', 'language', 'processing', 'nlp', 'is', 'a', 'subfield', 'of', 'linguistics', 'computer', 'science', 'and', 'artificial', 'intelligence']

# ['it', 'is', 'concerned', 'with', 'the', 'interactions', 'between', 'computers', 'and', 'human', 'language']

# ...

나. Word2Vec 모델 학습

gensim.models.Word2Vec클래스를 사용합니다.

from gensim.models import Word2Vec

# Word2Vec 모델 학습

# 주요 하이퍼파라미터:

# - sentences: 학습에 사용할 토큰화된 문장 리스트

# - vector_size: 임베딩 벡터의 차원 (예: 100, 200, 300)

# - window: 컨텍스트 윈도우 크기 (중심 단어 기준 앞뒤로 고려할 단어 수)

# - min_count: 모델 학습에 포함할 단어의 최소 등장 빈도 (이 값보다 적게 등장한 단어는 무시)

# - workers: 학습에 사용할 CPU 코어 수 (병렬 처리)

# - sg: 학습 알고리즘 선택 (0: CBOW, 1: Skip-gram)

# - hs: (0: Negative Sampling, 1: Hierarchical Softmax) - Negative Sampling이 주로 사용됨

# - negative: Negative Sampling 시 사용할 '노이즈 단어' 수 (보통 5-20)

# - epochs: 전체 데이터셋에 대한 학습 반복 횟수

model = Word2Vec(sentences=sentences,

vector_size=100, # 임베딩 벡터 차원

window=5, # 컨텍스트 윈도우 크기

min_count=1, # 최소 단어 빈도

workers=4, # CPU 코어 수

sg=0, # 0: CBOW, 1: Skip-gram (여기서는 CBOW 사용)

epochs=10) # 학습 반복 횟수

print("Word2Vec 모델 학습 완료!")

다. 학습된 모델 활용

- 어휘 확인:

model.wv.key_to_index(단어와 인덱스 매핑),model.wv.index_to_key(인덱스와 단어 매핑) - 특정 단어의 임베딩 벡터 확인:

model.wv['단어'] - 단어 간 유사도 계산:

model.wv.similarity('단어1', '단어2') - 가장 유사한 단어 찾기:

model.wv.most_similar('단어', topn=5) - 긍정/부정 단어를 사용한 유추:

model.wv.most_similar(positive=['woman', 'king'], negative=['man'], topn=1)(결과: queen)

# 어휘 확인 (일부)

# print("어휘:", list(model.wv.key_to_index.keys())[:10])

# print("첫 번째 단어:", model.wv.index_to_key[0])

# 특정 단어의 임베딩 벡터 확인

try:

vector_nlp = model.wv['nlp']

print("\n'nlp'의 임베딩 벡터 (일부):", vector_nlp[:5])

print("'nlp'의 임베딩 벡터 차원:", len(vector_nlp))

except KeyError:

print("\n'nlp' 단어가 어휘에 없습니다.")

# 단어 간 유사도 계산

try:

similarity_score = model.wv.similarity('language', 'natural')

print(f"\n'language'와 'natural'의 유사도: {similarity_score:.4f}")

except KeyError as e:

print(f"\n유사도 계산 오류: 단어 '{e.args[0]}'가 어휘에 없습니다.")

try:

similarity_score_diff = model.wv.similarity('computer', 'human')

print(f"'computer'와 'human'의 유사도: {similarity_score_diff:.4f}")

except KeyError as e:

print(f"유사도 계산 오류: 단어 '{e.args[0]}'가 어휘에 없습니다.")

# 가장 유사한 단어 찾기

try:

similar_words = model.wv.most_similar('processing', topn=3)

print("\n'processing'과 가장 유사한 단어들:", similar_words)

except KeyError:

print("\n'processing' 단어가 어휘에 없습니다.")

# 유추 (데이터가 작아 의미있는 결과가 안 나올 수 있음)

try:

# 예시: 'nlp' + 'language' - 'computer' 와 유사한 단어? (의미는 없을 수 있음)

analogy = model.wv.most_similar(positive=['nlp', 'language'], negative=['computer'], topn=1)

print("\n유추 ('nlp' + 'language' - 'computer'):", analogy)

except KeyError as e:

print(f"\n유추 오류: 단어 '{e.args[0]}'가 어휘에 없습니다.")

라. 모델 저장 및 로드

- 학습된 모델은 저장해두고 나중에 다시 불러와 사용할 수 있습니다.

# 모델 저장

model.save("word2vec_gensim.model")

print("\n모델 저장 완료: word2vec_gensim.model")

# 모델 로드

# loaded_model = Word2Vec.load("word2vec_gensim.model")

# print("\n모델 로드 완료!")

# vector_nlp_loaded = loaded_model.wv['nlp']

# print("'nlp'의 로드된 임베딩 벡터 (일부):", vector_nlp_loaded[:5])

3. 주요 하이퍼파라미터 설명

vector_size: 임베딩 벡터의 차원 수. 일반적으로 50~300 사이의 값을 사용. 차원이 클수록 더 많은 정보를 담을 수 있지만, 학습 데이터가 충분하지 않으면 과적합될 수 있고 계산량이 증가.window: 중심 단어를 기준으로 앞뒤로 몇 개의 단어까지를 문맥(context)으로 간주할지 결정. Skip-gram에서는 중심 단어로부터 예측할 주변 단어의 최대 거리. CBOW에서는 중심 단어를 예측하기 위해 사용될 주변 단어들의 범위. 보통 2~10 사이의 값을 사용.min_count: 학습에 사용할 단어의 최소 등장 빈도. 이 값보다 적게 등장한 단어는 어휘에서 제외. 희귀 단어를 무시하여 노이즈를 줄이고 학습 속도를 높일 수 있음. 기본값은 5.sg:0이면 CBOW 모델을 사용하고,1이면 Skip-gram 모델을 사용. Skip-gram이 일반적으로 더 좋은 성능을 보이지만 학습 시간이 오래 걸림.workers: 학습 시 사용할 CPU 스레드 수. 멀티코어 환경에서 학습 속도를 높일 수 있음.epochs: 전체 학습 데이터셋에 대한 반복 학습 횟수. 너무 작으면 충분히 학습되지 않고, 너무 크면 과적합되거나 학습 시간이 오래 걸림. Gensim 4.0.0부터iter대신epochs사용.hs(Hierarchical Softmax):1이면 계층적 소프트맥스를 사용하고,0이면 사용하지 않음.negative파라미터와 함께 사용되며, 둘 중 하나만 선택해야 함.negative(Negative Sampling):hs=0일 때 사용. 0보다 큰 값을 설정하면 네거티브 샘플링을 사용. 얼마나 많은 “노이즈 단어“를 네거티브 샘플로 사용할지 지정. Skip-gram의 경우 5-20, CBOW의 경우 2-5 정도의 값이 권장됨.alpha: 초기 학습률(learning rate).min_alpha: 학습률이 선형적으로 감소하여 도달하는 최소 학습률.

4. 사전 훈련된 Word2Vec 모델 (Pre-trained Word2Vec Models)

- 대규모 말뭉치(예: Google News, Wikipedia)로 미리 학습된 Word2Vec 모델을 다운로드하여 사용할 수도 있습니다.

- 이러한 모델은 이미 풍부한 의미 정보를 담고 있어, 특정 작업에 대한 전이 학습(Transfer Learning)에 유용합니다.

- Gensim의

gensim.downloader모듈을 통해 다양한 사전 훈련된 모델을 쉽게 로드할 수 있습니다.

# import gensim.downloader as api

# 사전 훈련된 모델 목록 보기

# print(list(api.info()['models'].keys()))

# 예: 'word2vec-google-news-300' 모델 로드 (시간이 오래 걸리고 용량이 큼)

# word2vec_google_model = api.load('word2vec-google-news-300')

# print("Google News Word2Vec 모델 로드 완료!")

# similarity_king_queen = word2vec_google_model.similarity('king', 'queen')

# print(f"'king'과 'queen'의 유사도 (Google News): {similarity_king_queen:.4f}")

추가 학습 자료

다음 학습 내용

- Day 65: 감성 분석 - 기본 기법 (Sentiment Analysis - Basic Techniques)

Day 65: 감성 분석 - 기본 기법 (Sentiment Analysis - Basic Techniques)

학습 목표

- 감성 분석(Sentiment Analysis) 또는 오피니언 마이닝(Opinion Mining)의 정의와 중요성 이해

- 감성 분석의 다양한 수준(문서, 문장, 속성 수준) 학습

- 감성 분석의 주요 접근 방식 소개:

- 감성 사전을 이용한 방법 (Lexicon-based Approach)

- 머신러닝 기반 방법 (Machine Learning-based Approach)

- 딥러닝 기반 방법 (Deep Learning-based Approach) - 간략 소개

- 감성 사전 기반 감성 분석의 기본 원리 및 장단점 파악

1. 감성 분석 (Sentiment Analysis)이란?

- 텍스트에 나타난 주관적인 의견, 감정, 태도, 평가 등을 식별하고 추출하여 정량화하는 자연어 처리 기술입니다.

- **오피니언 마이닝(Opinion Mining)**이라고도 불립니다.

- 주로 텍스트가 **긍정적(Positive), 부정적(Negative), 또는 중립적(Neutral)**인지 분류합니다. 때로는 더 세분화된 감정(예: 행복, 슬픔, 분노)을 분석하기도 합니다.

감성 분석의 중요성

- 비즈니스 인텔리전스: 고객 리뷰, 소셜 미디어 반응 등을 분석하여 제품/서비스 개선, 마케팅 전략 수립에 활용.

- 여론 분석: 정치, 사회적 이슈에 대한 대중의 의견 파악.

- 평판 관리: 특정 브랜드나 인물에 대한 온라인 평판 모니터링.

- 고객 지원: 고객 문의의 긴급성이나 불만 정도 파악.

2. 감성 분석의 수준

가. 문서 수준 (Document-level)

- 전체 문서(예: 영화 리뷰, 제품 설명)가 전반적으로 긍정적인지 부정적인지, 중립적인지를 판단합니다.

- 문서가 단일 주제에 대한 의견을 담고 있다고 가정합니다.

나. 문장 수준 (Sentence-level / Aspect-level의 한 형태)

- 각 문장이 표현하는 감성을 분석합니다.

- 하나의 문서 내에서도 여러 감성이 혼재할 수 있기 때문에 더 세밀한 분석이 가능합니다.

- 예: “이 영화의 스토리는 훌륭했지만, 연기는 실망스러웠다.” -> 첫 번째 절은 긍정, 두 번째 절은 부정.

다. 속성 수준 (Aspect-level / Feature-based)

- 텍스트에서 언급된 특정 대상(개체, 속성)에 대한 감성을 분석합니다.

- 가장 세분화된 분석 수준으로, 무엇에 대해 어떤 감정을 느끼는지 구체적으로 파악할 수 있습니다.

- 예: “아이폰의 카메라는 훌륭하지만 배터리는 아쉽다.”

- 카메라 (속성) -> 긍정적

- 배터리 (속성) -> 부정적

3. 감성 분석 접근 방식

가. 감성 사전 기반 접근법 (Lexicon-based Approach)

- 단어와 그 단어가 가지는 감성 점수(긍정/부정/중립 및 강도)를 담고 있는 **감성 사전(Sentiment Lexicon)**을 사용합니다.

- 텍스트 내 단어들의 감성 점수를 합산하거나 평균내어 전체 텍스트의 감성을 판단합니다.

- 장점:

- 구현이 비교적 간단합니다.

- 별도의 학습 데이터가 필요하지 않을 수 있습니다 (사전만 있다면).

- 특정 도메인에 맞는 사전을 구축하면 해당 도메인에서 좋은 성능을 보일 수 있습니다.

- 단점:

- 문맥 처리의 한계: 단어의 의미는 문맥에 따라 달라지지만, 사전 기반 방식은 이를 고려하기 어렵습니다. (예: “not good“에서 “good“은 긍정이지만 “not“과 함께 부정으로 해석되어야 함)

- 신조어 및 비유적 표현 처리 어려움: 사전에 없는 단어나 새로운 표현에 취약합니다.

- 도메인 의존성: 일반적인 감성 사전은 특정 도메인의 전문 용어나 감성 표현을 반영하지 못할 수 있습니다.

- 감성 강도 조절의 어려움: 미묘한 감정의 차이나 강도를 정교하게 반영하기 어렵습니다.

- 주요 감성 사전:

- SentiWordNet: WordNet의 각 synset에 긍정, 부정, 객관성 점수를 할당.

- VADER (Valence Aware Dictionary and sEntiment Reasoner): 소셜 미디어 텍스트 분석에 특화된 사전 및 규칙 기반 시스템.

- AFINN: 각 단어에 -5(부정)에서 +5(긍정) 사이의 점수를 할당.

- 한국어 감성 사전: KNU 한국어 감성사전 등.

기본 알고리즘 (감성 사전 기반)

- 텍스트를 토큰화합니다.

- 각 토큰에 대해 감성 사전을 참조하여 감성 점수를 가져옵니다.

- (선택) 부정어(예: “not”, “안”) 처리: 부정어 뒤에 오는 긍정 단어는 부정으로, 부정 단어는 긍정으로 반전시킵니다.

- (선택) 강조어(예: “very”, “너무”) 처리: 감성 점수의 강도를 조절합니다.

- 문서 전체 또는 문장 전체의 감성 점수를 합산하거나 평균냅니다.

- 최종 점수를 기준으로 긍정, 부정, 중립으로 분류합니다.

나. 머신러닝 기반 접근법 (Machine Learning-based Approach)

- 감성 레이블(긍정/부정/중립)이 태깅된 학습 데이터를 사용하여 분류 모델을 학습시킵니다.

- 텍스트로부터 특징(Features)을 추출하고 (예: BoW, TF-IDF, Word Embeddings), 이를 입력으로 사용하여 지도 학습 알고리즘(예: Naive Bayes, Logistic Regression, SVM, Random Forest)을 훈련시킵니다.

- 장점:

- 데이터로부터 패턴을 학습하므로 문맥 정보를 어느 정도 반영할 수 있습니다.

- 특정 도메인의 데이터로 학습하면 해당 도메인에 특화된 모델을 만들 수 있습니다.

- 단점:

- 대량의 레이블링된 학습 데이터가 필요합니다.

- 특징 공학(Feature Engineering)이 모델 성능에 큰 영향을 미칩니다.

다. 딥러닝 기반 접근법 (Deep Learning-based Approach)

- 최근 가장 활발히 연구되고 좋은 성능을 보이는 접근 방식입니다.

- 순환 신경망(RNN, LSTM, GRU)이나 컨볼루션 신경망(CNN), 트랜스포머(Transformer) 기반 모델(예: BERT, GPT)을 사용하여 텍스트의 의미와 문맥을 학습합니다.

- 단어 임베딩을 입력으로 사용하여 텍스트의 연속적인 표현을 학습합니다.

- 장점:

- 특징 공학의 필요성을 줄여줍니다 (End-to-end learning).

- 복잡한 문맥 정보와 미묘한 감정 표현을 더 잘 포착할 수 있습니다.

- 최신 모델들은 매우 높은 정확도를 보입니다.

- 단점:

- 대량의 학습 데이터와 많은 계산 자원(GPU 등)이 필요합니다.

- 모델이 복잡하여 해석하기 어려울 수 있습니다 (Black box).

4. 감성 분석의 도전 과제

- 미묘한 표현 및 풍자/비꼬는 말투: “이 영화 정말 ’최고’다.” (실제로는 부정적)

- 중의적 표현: 문맥에 따라 긍/부정이 달라지는 표현.

- 주관성 탐지: 객관적인 사실과 주관적인 의견을 구분하는 것.

- 비교급 표현: “A는 B보다 좋다.”

- 도메인 특화성: 한 도메인에서 긍정인 단어가 다른 도메인에서는 부정일 수 있음.

추가 학습 자료

- NLTK Book - Chapter 6: Learning to Classify Text (Sentiment Analysis 예제 포함)

- VADER Sentiment Analysis (GitHub)

- 딥 러닝을 이용한 자연어 처리 입문 - 감성 분석

다음 학습 내용

- Day 66: 간단한 감성 분석기 구축 (Building a simple Sentiment Analyzer)

Day 66: 간단한 감성 분석기 구축 (Building a simple Sentiment Analyzer)

학습 목표

- 감성 사전을 이용하여 간단한 규칙 기반 감성 분석기 구현

- 머신러닝 기반 감성 분석기 (TF-IDF + Logistic Regression) 구현

scikit-learn을 활용한 텍스트 분류 모델 학습 및 평가

1. 감성 사전 기반 감성 분석기 구현

가. 사용할 감성 사전

- 여기서는 간단하게 직접 작은 규모의 긍정/부정 단어 사전을 정의하여 사용합니다.

- 실제로는 AFINN, SentiWordNet, KNU 한국어 감성사전 등을 활용할 수 있습니다.

나. 구현 단계

- 간단한 감성 사전 정의: 긍정 단어와 부정 단어 리스트를 만듭니다.

- 텍스트 입력 및 전처리: 분석할 텍스트를 입력받고, 기본적인 전처리(토큰화, 소문자화 등)를 수행합니다.

- 감성 점수 계산:

- 텍스트 내 각 토큰이 긍정 사전에 있으면 +1, 부정 사전에 있으면 -1을 부여합니다.

- (선택적) 부정어 처리: “not“과 같은 부정어가 긍정 단어 앞에 오면 점수를 반전시킵니다.

- 최종 감성 판단: 계산된 총 점수를 기준으로 긍정, 부정, 중립을 판단합니다.

다. 파이썬 코드 예시 (간단한 사전 기반)

# 1. 간단한 감성 사전 정의

positive_words = ['good', 'great', 'awesome', 'happy', 'love', 'excellent', 'nice', 'wonderful', 'best']

negative_words = ['bad', 'terrible', 'awful', 'sad', 'hate', 'poor', 'worst', 'horrible']

# 간단한 부정어 리스트

negation_words = ['not', 'no', 'never']

def simple_lexicon_sentiment(text):

text = text.lower()

words = text.split() # 간단한 공백 기준 토큰화

score = 0

negation_active = False

for i, word in enumerate(words):

# 부정어 처리 (다음 단어에 영향)

if word in negation_words:

negation_active = True

continue

current_word_score = 0

if word in positive_words:

current_word_score = 1

elif word in negative_words:

current_word_score = -1

if negation_active:

current_word_score *= -1

negation_active = False # 부정어 효과는 한 단어에만 적용 (간단화)

score += current_word_score

if score > 0:

return "Positive"

elif score < 0:

return "Negative"

else:

return "Neutral"

# 테스트

review1 = "This movie is very good and I love it"

review2 = "The food was terrible and the service was poor"

review3 = "It's not bad, actually quite nice" # 부정어 처리 테스트

review4 = "This is a book." # 중립 테스트

print(f"'{review1}' -> Sentiment: {simple_lexicon_sentiment(review1)}")

print(f"'{review2}' -> Sentiment: {simple_lexicon_sentiment(review2)}")

print(f"'{review3}' -> Sentiment: {simple_lexicon_sentiment(review3)}")

print(f"'{review4}' -> Sentiment: {simple_lexicon_sentiment(review4)}")

라. 한계점

- 위 예시는 매우 단순하며, 실제 감성 분석에는 부족한 점이 많습니다.

- 문맥, 비유, 신조어 처리 불가

- 감성 강도 표현 미흡

- 제한된 어휘

2. 머신러닝 기반 감성 분석기 구현

가. 데이터 준비

- 레이블링된 데이터셋이 필요합니다 (예: 영화 리뷰와 해당 리뷰의 긍정/부정 레이블).

- 여기서는 간단한 예제 데이터를 직접 만듭니다. 실제로는 IMDB 영화 리뷰 데이터셋, 네이버 영화 리뷰 데이터셋 등을 사용할 수 있습니다.

# 예제 데이터 (텍스트, 레이블) - 레이블: 1 (긍정), 0 (부정)

train_data = [

("This is a great movie, I loved it!", 1),

("The plot was amazing and the actors were brilliant.", 1),

("What a fantastic film, truly inspiring.", 1),

("I enjoyed every moment of this masterpiece.", 1),

("Absolutely wonderful, a must-see for everyone.", 1),

("This movie was terrible, a complete waste of time.", 0),

("I hated it, the acting was awful.", 0),

("A boring and predictable storyline.", 0),

("The worst film I have ever seen.", 0),

("I do not recommend this movie to anyone.", 0),

("It was okay, not great but not bad either.", 1), # 중립적인 것을 긍정으로 가정 (간단화)

("The movie is neither good nor bad.", 0) # 중립적인 것을 부정으로 가정 (간단화)

]

train_texts = [data[0] for data in train_data]

train_labels = [data[1] for data in train_data]

나. 특징 추출 (TF-IDF)

scikit-learn의TfidfVectorizer를 사용합니다.

from sklearn.feature_extraction.text import TfidfVectorizer

vectorizer = TfidfVectorizer(stop_words='english', # 불용어 제거 (영어)

max_features=1000) # 최대 특징 수 제한 (어휘 크기)

# 학습 데이터에 대해 TF-IDF 행렬 생성

X_train_tfidf = vectorizer.fit_transform(train_texts)

print("TF-IDF 행렬 크기:", X_train_tfidf.shape)

# print("어휘 일부:", vectorizer.get_feature_names_out()[:20])

다. 모델 학습 (로지스틱 회귀)

scikit-learn의LogisticRegression을 사용합니다.

from sklearn.linear_model import LogisticRegression

# 로지스틱 회귀 모델 초기화 및 학습

model_lr = LogisticRegression()

model_lr.fit(X_train_tfidf, train_labels)

print("로지스틱 회귀 모델 학습 완료!")

라. 모델 평가 및 예측

- 간단한 테스트 데이터를 사용하여 예측을 수행합니다.

- 실제로는 별도의 테스트 데이터셋을 사용하고, 정확도, 정밀도, 재현율, F1 점수 등으로 평가해야 합니다.

# 테스트 데이터

test_data = [

"I really liked this film, it was fantastic!", # 예상: 긍정 (1)

"A truly awful experience, I would not watch it again.", # 예상: 부정 (0)

"The movie was not good at all.", # 예상: 부정 (0)

"It was an average movie." # 예상: ? (데이터 및 모델에 따라 다름)

]

# 테스트 데이터에 대해 TF-IDF 변환 (학습 시 사용한 vectorizer 사용)

X_test_tfidf = vectorizer.transform(test_data)

# 예측

predictions = model_lr.predict(X_test_tfidf)

predicted_labels = ["Positive" if p == 1 else "Negative" for p in predictions]

for text, label in zip(test_data, predicted_labels):

print(f"'{text}' -> Predicted Sentiment: {label}")

# (선택) 예측 확률 확인

# probabilities = model_lr.predict_proba(X_test_tfidf)

# for text, prob in zip(test_data, probabilities):

# print(f"'{text}' -> Probabilities (Neg, Pos): {prob}")

마. 전체 코드 흐름 (머신러닝 기반)

from sklearn.feature_extraction.text import TfidfVectorizer

from sklearn.linear_model import LogisticRegression

from sklearn.model_selection import train_test_split # 데이터 분할용

from sklearn.metrics import accuracy_score # 평가용

# 1. 데이터 준비 (더 많은 데이터가 필요함)

texts = [

"This is a great movie, I loved it!", "The plot was amazing and the actors were brilliant.",

"What a fantastic film, truly inspiring.", "I enjoyed every moment of this masterpiece.",

"Absolutely wonderful, a must-see for everyone.", "This movie was terrible, a complete waste of time.",

"I hated it, the acting was awful.", "A boring and predictable storyline.",

"The worst film I have ever seen.", "I do not recommend this movie to anyone.",

"It was okay, not great but not bad either.", "The movie is neither good nor bad.",

"An excellent story with powerful performances.", "Just a so-so movie, nothing special.",

"I was deeply disappointed by this film.", "Two thumbs up for this amazing flick!"

]

labels = [1, 1, 1, 1, 1, 0, 0, 0, 0, 0, 1, 0, 1, 0, 0, 1] # 1: Positive, 0: Negative

# 2. 데이터 분할 (학습용, 테스트용)

X_train, X_test, y_train, y_test = train_test_split(texts, labels, test_size=0.25, random_state=42)

# 3. 특징 추출 (TF-IDF)

vectorizer = TfidfVectorizer(stop_words='english', max_features=1000)

X_train_tfidf = vectorizer.fit_transform(X_train)

X_test_tfidf = vectorizer.transform(X_test) # 테스트 데이터는 학습된 vectorizer로 transform만 수행

# 4. 모델 학습 (로지스틱 회귀)

model_lr = LogisticRegression()

model_lr.fit(X_train_tfidf, y_train)

# 5. 모델 평가

y_pred = model_lr.predict(X_test_tfidf)

accuracy = accuracy_score(y_test, y_pred)

print(f"\n모델 정확도 (Accuracy on Test Set): {accuracy:.4f}")

# 6. 새로운 텍스트 예측

new_reviews = [

"This is the best movie I have seen in years!",

"What a waste of money and time."

]

new_reviews_tfidf = vectorizer.transform(new_reviews)

new_predictions = model_lr.predict(new_reviews_tfidf)

new_predicted_labels = ["Positive" if p == 1 else "Negative" for p in new_predictions]

for review, label in zip(new_reviews, new_predicted_labels):

print(f"New Review: '{review}' -> Predicted Sentiment: {label}")

3. 고려 사항 및 개선 방향

- 데이터: 더 많고 다양한 학습 데이터가 필요합니다.

- 전처리: 더 정교한 전처리(표제어 추출, 특수문자 처리 등)를 적용할 수 있습니다.

- 특징 공학: N-gram, 단어 임베딩(Word2Vec, FastText) 등을 특징으로 사용할 수 있습니다.

- 모델 선택: Naive Bayes, SVM, RandomForest 등 다른 분류 모델을 시도해볼 수 있습니다.

- 하이퍼파라미터 튜닝:

GridSearchCV등을 사용하여 모델의 하이퍼파라미터를 최적화할 수 있습니다. - 딥러닝 모델: LSTM, CNN, BERT와 같은 딥러닝 모델을 사용하면 더 높은 성능을 기대할 수 있습니다 (더 많은 데이터와 계산 자원 필요).

- 한국어: 한국어의 경우 KoNLPy를 사용한 형태소 분석 및 적절한 토큰화가 필수적입니다.

추가 학습 자료

- Scikit-learn Tutorial: Working With Text Data

- IMDB 영화 리뷰 감성 분석 (캐글 노트북 예시 다수) (Word2Vec 사용 예시도 포함)

다음 학습 내용

- Day 67: 순환 신경망 (RNN) 소개 (Introduction to Recurrent Neural Networks (RNNs))

Day 67: 순환 신경망 (RNN) 소개 (Introduction to Recurrent Neural Networks (RNNs))

학습 목표

- 순차 데이터(Sequential Data)의 특징과 기존 신경망의 한계점 이해

- 순환 신경망(RNN)의 기본 구조와 작동 원리 학습

- RNN의 “메모리” 역할과 순환적 연결의 의미 파악

- RNN의 다양한 유형(one-to-many, many-to-one, many-to-many) 소개

- RNN의 주요 응용 분야 및 한계점(장기 의존성 문제) 인식

1. 순차 데이터 (Sequential Data)

- 정의: 시간의 흐름이나 순서에 따라 나타나는 데이터. 각 데이터 포인트는 이전 데이터 포인트와 독립적이지 않고 연관성을 가집니다.

- 예시:

- 자연어: 문장 내 단어들의 순서, 문서 내 문장들의 순서.

- 음성: 시간에 따른 음파 신호.

- 시계열 데이터: 주가, 날씨 변화, 센서 데이터 등.

- DNA 염기서열.

- 동영상: 프레임들의 연속.

기존 신경망(DNN, CNN)의 한계

- DNN (Deep Neural Network) / Feedforward Neural Network:

- 입력 데이터의 순서를 고려하지 않습니다. 각 입력은 독립적으로 처리됩니다.

- 고정된 크기의 입력을 가정합니다. (예: BoW 벡터, 고정 크기 이미지)

- 순차 데이터의 시간적 의존성을 모델링하기 어렵습니다.

- CNN (Convolutional Neural Network):

- 주로 이미지와 같이 공간적 구조를 가진 데이터 처리에 강점을 보입니다.

- 필터를 통해 지역적 특징을 추출하지만, 전체 시퀀스의 장기적인 의존성을 파악하는 데는 한계가 있을 수 있습니다. (1D CNN으로 시퀀스 처리가 가능하지만, RNN과는 다른 방식)

2. 순환 신경망 (Recurrent Neural Network, RNN)

- 정의: 순차 데이터 처리에 특화된 인공 신경망의 한 종류입니다.

- 핵심 아이디어: 네트워크 내부에 **순환적인 연결(Recurrent Connection)**을 포함하여, 이전 타임스텝(time step)의 정보를 현재 타임스텝의 계산에 활용합니다. 이를 통해 “메모리“와 유사한 역할을 수행하여 시퀀스 내의 정보를 기억하고 전달할 수 있습니다.

RNN의 기본 구조

- 각 타임스텝

t에서 RNN 셀은 두 가지 입력을 받습니다:- 현재 타임스텝의 입력 (xt)

- 이전 타임스텝의 은닉 상태 (hidden state, ht-1)

- 이 두 입력을 사용하여 현재 타임스텝의 **은닉 상태 (ht)**를 계산하고, 필요에 따라 **출력 (yt)**을 생성합니다.

- 은닉 상태

h_t는 다음 타임스텝으로 전달되어 과거의 정보를 요약하고 전달하는 역할을 합니다.

(이미지 출처: Christopher Olah’s blog)

(이미지 출처: Christopher Olah’s blog)

- 수식 표현:

- 은닉 상태 계산: ht = tanh(Whh * ht-1 + Wxh * xt + bh)

- Whh: 이전 은닉 상태에서 현재 은닉 상태로의 가중치 행렬

- Wxh: 현재 입력에서 현재 은닉 상태로의 가중치 행렬

- bh: 은닉 상태의 편향 벡터

- tanh: 활성화 함수 (주로 하이퍼볼릭 탄젠트 사용)

- 출력 계산 (선택 사항): yt = Why * ht + by

- Why: 현재 은닉 상태에서 출력으로의 가중치 행렬

- by: 출력의 편향 벡터

- 은닉 상태 계산: ht = tanh(Whh * ht-1 + Wxh * xt + bh)

- 가중치 공유 (Weight Sharing): RNN은 모든 타임스텝에서 동일한 가중치 행렬(Whh, Wxh, Why)과 편향(bh, by)을 사용합니다. 이는 모델의 파라미터 수를 줄이고, 다양한 길이의 시퀀스에 대해 일반화할 수 있게 합니다.

RNN의 “메모리”

- 은닉 상태

h_t는 과거 타임스텝들의 정보를 요약하여 저장하고 있는 것으로 해석될 수 있습니다. - 이 “메모리“를 통해 RNN은 시퀀스 내의 의존성을 학습할 수 있습니다.

3. RNN의 다양한 구조 (유형)

입력 시퀀스와 출력 시퀀스의 길이에 따라 다양한 형태의 RNN 구조가 가능합니다.

(이미지 출처: Stack Overflow, Andrej Karpathy)

(이미지 출처: Stack Overflow, Andrej Karpathy)

- One-to-One (바닐라 신경망): 하나의 입력, 하나의 출력. (엄밀히는 RNN이 아님)

- 예: 이미지 분류 (고정 크기 입력)

- One-to-Many: 하나의 입력을 받아 여러 개의 출력을 순차적으로 생성.

- 예: 이미지 캡셔닝 (이미지 입력 -> 단어 시퀀스 출력)

- Many-to-One: 여러 개의 입력을 순차적으로 받아 하나의 출력을 생성.

- 예: 감성 분석 (단어 시퀀스 입력 -> 긍정/부정 레이블 출력), 텍스트 분류.

- Many-to-Many (동일 길이): 입력 시퀀스와 동일한 길이의 출력 시퀀스를 생성. 각 타임스텝마다 출력이 나옴.

- 예: 품사 태깅 (단어 시퀀스 입력 -> 품사 태그 시퀀스 출력), 개체명 인식.

- Many-to-Many (다른 길이, Sequence-to-Sequence): 입력 시퀀스와 다른 길이의 출력 시퀀스를 생성. 인코더-디코더 구조에서 주로 사용.

- 예: 기계 번역 (소스 언어 문장 입력 -> 타겟 언어 문장 출력), 챗봇.

4. RNN의 주요 응용 분야

- 자연어 처리 (NLP):

- 언어 모델링 (Language Modeling)

- 기계 번역 (Machine Translation)

- 텍스트 생성 (Text Generation)

- 감성 분석 (Sentiment Analysis)

- 질의응답 (Question Answering)

- 품사 태깅 (Part-of-Speech Tagging)

- 음성 인식 (Speech Recognition)

- 시계열 예측 (Time Series Prediction)

- 이미지 캡셔닝 (Image Captioning)

- 비디오 분석 (Video Analysis)

5. RNN의 한계점: 장기 의존성 문제 (Long-Term Dependency Problem)

- RNN은 이론적으로는 과거의 정보를 모두 기억할 수 있지만, 실제로는 시퀀스가 길어질수록 앞쪽의 정보가 뒤쪽으로 제대로 전달되지 못하는 문제가 발생합니다.

- 이는 역전파 과정에서 기울기가 너무 작아지거나(Vanishing Gradient) 너무 커지는(Exploding Gradient) 현상 때문에 발생합니다.